・

Qwen3-Max-Thinkingは実務向きか|複雑な条件整理と推論タスクを丸投げして能力を判断

生成AIは、単に膨大な知識を蓄積し回答するだけでなく、人間のように複雑な問題を「思考」して解決策を導き出せるようになりました。

Alibaba CloudのQwenチームによって開発された「Qwen3-Max-Thinking」は、従来の生成AIが得意としていた文章生成や翻訳といったタスクに加え、高度な数学的推論や論理的な問題解決も得意です。

特に、回答を出力する前に内部で思考プロセスを展開する「Thinking Mode」と、必要に応じて自律的に外部ツールを活用する「Adaptive Tool-Use」という2つの革新的な機能が注目されています。

これにより、ユーザーが細かく指示を出さずとも、AI自身が最適な解決手順を組み立て、実行することが可能になりました。

本記事では、このモデルの仕組みや特徴を深掘りし、実際にどのような挙動を示すのかを検証を通じてご紹介します。

✍️Qwen3-Max-Thinkingの主な特徴

Qwen3-Max-Thinkingは、大規模言語モデル(LLM)の中でも特に「推論(Reasoning)」に重点を置いて設計されたモデルです。

従来のモデルが、学習したデータに基づいて確率的にもっともらしい言葉を繋いでいたのに対し、このモデルは論理的なステップを積み重ねることで正解に到達しようとします。

ここでは、その性能を支える「Thinking Mode」、「Adaptive Tool-Use」、そして「ベンチマークスコア」という3つの側面から、本モデルについて詳しく解説します。

思考プロセスを可視化する「Thinking Mode」

「Thinking Mode(思考モード)」は、Qwen3-Max-Thinkingの最大の特徴であり、AIが回答を生成する前に「考える時間」を設ける機能です。

人間が難しい問題に直面した際、すぐに答えを出すのではなく、頭の中で情報を整理し、計算し、論理を確認してから発言するのと同様のプロセスをAIが行います。

-

内部的な試行錯誤の実現

従来のLLMは、入力に対して即座にトークン(言葉)を生成し始めるため、複雑な計算や多段階の論理が必要な問題でミスを犯すことがありました。Thinking Modeでは、AIが内部的に「まずは前提条件を整理しよう」「次にこの計算を行おう」「この結論は矛盾していないか」といった思考のステップ(Chain of Thought)を展開します。これにより、単なる知識の検索ではなく、論理的な構築が可能となり、数学やプログラミング、複雑な論理パズルなどのタスクで精度向上を実現しています。 -

ハルシネーション(嘘の回答)の低減

AIがもっともらしい嘘をつく「ハルシネーション」は、多くの場合、論理の飛躍や事実確認の欠如から生じます。Thinking Modeでは、AIが自らの思考過程をステップバイステップで確認しながら進むため、論理的な矛盾に気づきやすくなります。思考プロセスの中で「あ、この仮定は間違っていたので修正する」といった自己修正を行う挙動も見られ、結果として出力される回答の信頼性が高まっています。 -

プロセスの可視化による透明性

このモードの興味深い点は、AIがどのようにしてその結論に至ったかという「思考ログ」をユーザーが確認できる場合があることです(プラットフォームの仕様による)。ブラックボックスになりがちなAIの判断プロセスが可視化されることで、ユーザーは回答の正当性を検証しやすくなり、ビジネスなどの重要な局面でもAIの提案を採用しやすくなります。

自律的に道具を使う「Adaptive Tool-Use」

「Adaptive Tool-Use(適応的ツール利用)」は、AIが与えられたタスクを解決するために、必要な道具(ツール)を自律的に判断して使用する機能です。

これまでのAI活用では、ユーザーが「検索して教えて」「計算機能を使って」と明示的に指示する必要がありましたが、Qwen3-Max-Thinkingはその必要をなくしました。

-

Web検索と知識の補完

モデルが自身の学習データだけでは回答できない最新情報や、具体的な事実確認が必要だと判断した場合、自律的にWeb検索を実行します。例えば「昨日の特定のスポーツの試合結果」や「現在の株価」など、リアルタイム性が求められる情報について、ユーザーが指示しなくても検索を行い、その結果を回答に反映させます。これにより、知識のカットオフ(学習データの期間制限)による制約を乗り越え、最新の情報を踏まえた推論が可能になります。 -

Code Interpreterによる正確な計算

言語モデルは本来、計算が苦手です。「1234×5678」のような単純な計算でも、言葉の確率として処理しようとするため間違えることがあります。しかし、Qwen3-Max-Thinkingは計算が必要な場面で、裏側でPythonなどのプログラムコードを生成し、それを実行することで正確な数値を得ます。グラフの描画やデータの分析といった処理も、コード実行を通じて行うため、非常に正確で高度なアウトプットが可能となります。 -

ツール利用のシームレスな統合

この機能の真価は、「検索」と「計算」を組み合わせて使える点にあります。「ある企業の過去5年間の売上推移を検索し、その成長率を計算してグラフにする」といった複合的なタスクでも、AIが自ら手順を分解し、検索でデータを集め、コード実行で分析するという一連の流れを完遂します。ユーザーは最終的な結果だけを受け取ることができるため、AIを使ったタスクが効率化します。

ベンチマーク性能と競合モデルとの比較

AIモデルの性能を測る客観的な指標であるベンチマークテストにおいても、Qwen3-Max-Thinkingは、世界トップクラスのモデルと肩を並べる実力を示しています。

特に、単なる知識量ではなく、推論能力が問われるテストでの強さが際立っています。

-

数学・理数系タスクでの圧倒的な強さ

数学の難問を解く「MATH」や「AIME」といったベンチマーク、あるいは物理や化学などの理数系知識を問う「GPQA Diamond」において、Thinking Modeを有効にしたQwen3-Max-Thinkingは非常に高いスコアを叩き出しています。

これは、GPT-5.2やGemini 3 Proといった競合のフラグシップモデルと比較しても互角以上の成績であり、特に複雑なステップを踏む必要がある問題解決において、その推論能力の高さが証明されています。 -

コーディング能力の向上

プログラミングコードの生成や修正を行う「HumanEval」や「LiveCodeBench」などのテストでも、高いパフォーマンスを発揮しています。思考プロセスを経ることで、単にコードを書くだけでなく、エッジケース(稀に起こる不具合の条件)を考慮したり、より効率的なアルゴリズムを選択したりすることが可能になっています。また、生成したコードにバグがあった場合に、思考プロセス内で自己修正を行う能力も、スコア向上に寄与しています。 -

複合的な難問への対応力

検索や計算を組み合わせる必要がある、より実践的で難易度の高いベンチマーク(例:Humanity's Last Examなど)においても、Adaptive Tool-Use機能が効果を発揮しています。自社発表によれば競合を大きく上回るスコアを記録していますが、非常に難易度の高いテストであるため、実務での適用には検証が推奨されています。

⭐YoomはAIを活用した業務フローを自動化できます

Qwen3-Max-Thinkingのような高度な推論能力を持つAIモデルの登場は、ビジネスの現場における自動化の可能性を大きく広げます。

自動化プラットフォーム「Yoom」を活用すれば、プログラミングの知識がなくても、QwenのようなAIの力を日々の業務フローに組み込むことが可能です。

Yoomは、様々なSaaSアプリやAIモデルをノーコードで連携させることができるため、会議の議事録がデータベースに追加されたら、AIが内容を分析・要約し、重要な決定事項をチャットツールでチームに共有するといったフローも、テンプレートを使って簡単に構築できます。

まずは、以下のテンプレートを使って、AIと業務アプリの連携を体験してみてください。

- ChatGPTを活用して、日々の議事録作成や要約業務を効率化したいと考えている方

- Yoomデータベースに蓄積した情報を、手作業でSlackに通知している方

- 会議後の情報共有プロセスを自動化し、チームの生産性を向上させたい方

- データベースへの議事録追加をきっかけに、ChatGPTによる要約とSlack通知が自動で実行されるため、これまで手作業に費やしていた時間を削減できます。

- 議事録の要約や通知フォーマットが統一されるため、属人化を防ぎ、チーム内での情報共有の質を均一に保つことにも繋がります。

- はじめに、ChatGPTとSlackをYoomと連携します。

- 次に、トリガーでYoomデータベーストリガーを選択し、「レコードを選択して起動」というアクションを設定します。

- 次に、オペレーションでChatGPTを選択し、「要約する」アクションを設定し、トリガーで取得した議事録の内容を要約するように指定します。

- 最後に、オペレーションでSlackを選択し、「メッセージで通知する」アクションを設定し、ChatGPTが生成した要約を指定のチャンネルに通知します。

■このワークフローのカスタムポイント

- Yoomデータベーストリガーで、議事録を管理しているデータベースやテーブルを任意で設定してください。

- ChatGPTで要約するアクションを設定する際に、「箇条書きでまとめて」や「結論を先に述べて」など、要約に関する指示内容を任意で設定できます。

- Slackに通知するメッセージは、ChatGPTが生成した要約だけでなく、議事録のタイトルや作成日など、データベースの情報を組み合わせて任意で設定できます。

- ChatGPT、SlackのそれぞれとYoomを連携してください。

- ChatGPT(OpenAI)のアクションを実行するには、OpenAIのAPI有料プランの契約が必要です。(APIが使用されたときに支払いができる状態)

- 詳しくはOpenAIの「API料金」ページをご確認ください。

- ChatGPTのAPI利用はOpenAI社が有料で提供しており、API疎通時のトークンにより従量課金される仕組みとなっています。そのため、API使用時にお支払いが行える状況でない場合エラーが発生しますのでご注意ください。

■このテンプレートをおすすめする方

- 大量のGmailから重要な情報を効率的に収集したいと考えている方

- Geminiを活用して、メールの内容の要約を自動化したいと考えている方

- Google スプレッドシートでメールから得た情報を一元管理したい方

■このテンプレートを使うメリット

- Gmailの内容確認と要約、転記作業が自動化されるため、これまで手作業に費やしていた時間を短縮し、より重要な業務に集中できます。

- メールの内容がGeminiによって要約され、Google スプレッドシートに自動で蓄積されるため、情報の一元管理とスムーズな共有が可能です。

■フローボットの流れ

- はじめに、Gmail、Gemini、Google スプレッドシートをYoomと連携します。

- 次に、トリガーでGmailを選択し、「特定のラベルのメールを受信したら」というアクションを設定します。

- 次に、オペレーションでGeminiを選択し、受信したメール本文を要約するように「コンテンツを生成」アクションを設定します。

- 最後に、オペレーションでGoogle スプレッドシートを選択し、Geminiが生成した要約結果などを指定のシートに行として追加するアクションを設定します。

■このワークフローのカスタムポイント

- Gmailのトリガー設定では、自動化の対象としたいメールに付与するラベルを任意で設定してください。

- Geminiのアクション設定では、要約の精度や形式を調整するため、プロンプトや使用するモデルを任意で設定できます。

- Google スプレッドシートへの追加アクションでは、書き込み先となるスプレッドシートIDやシート名を任意で設定してください。

■注意事項

- Gemini、Gmail、Google スプレッドシートのそれぞれとYoomを連携してください。

- トリガーは5分、10分、15分、30分、60分の間隔で起動間隔を選択できます。

- プランによって最短の起動間隔が異なりますので、ご注意ください。

🤔【検証】Qwen3-Max-Thinkingを実際に使ってみた

特別なデータやプログラミングの知識がなくても試せる内容で、その「思考」と「ツール利用」の挙動を確認しました。

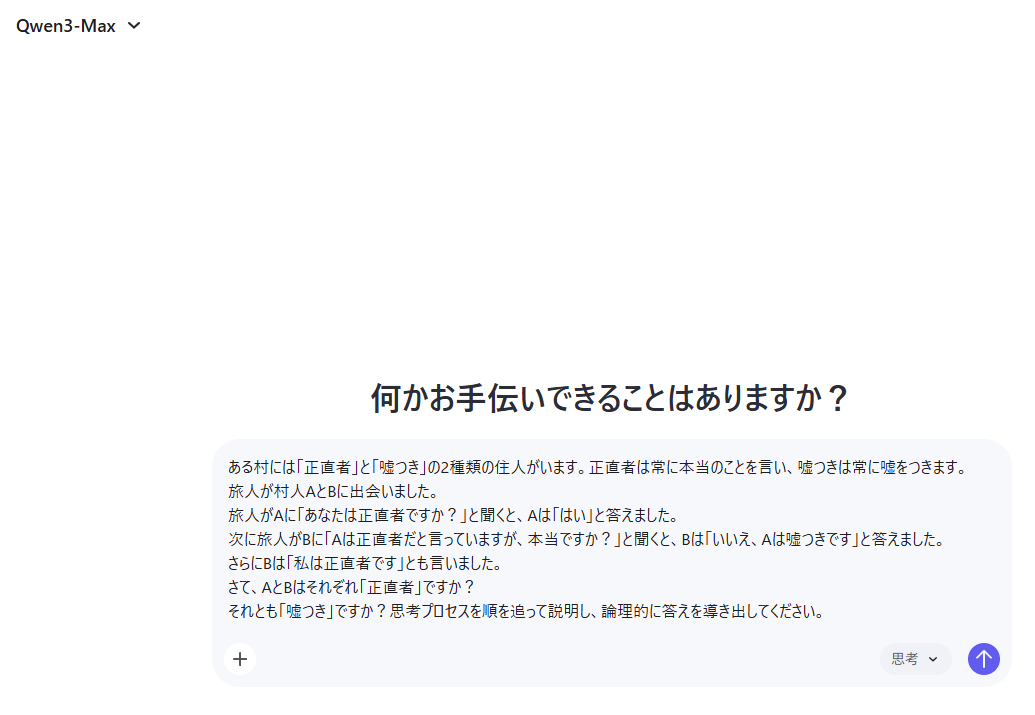

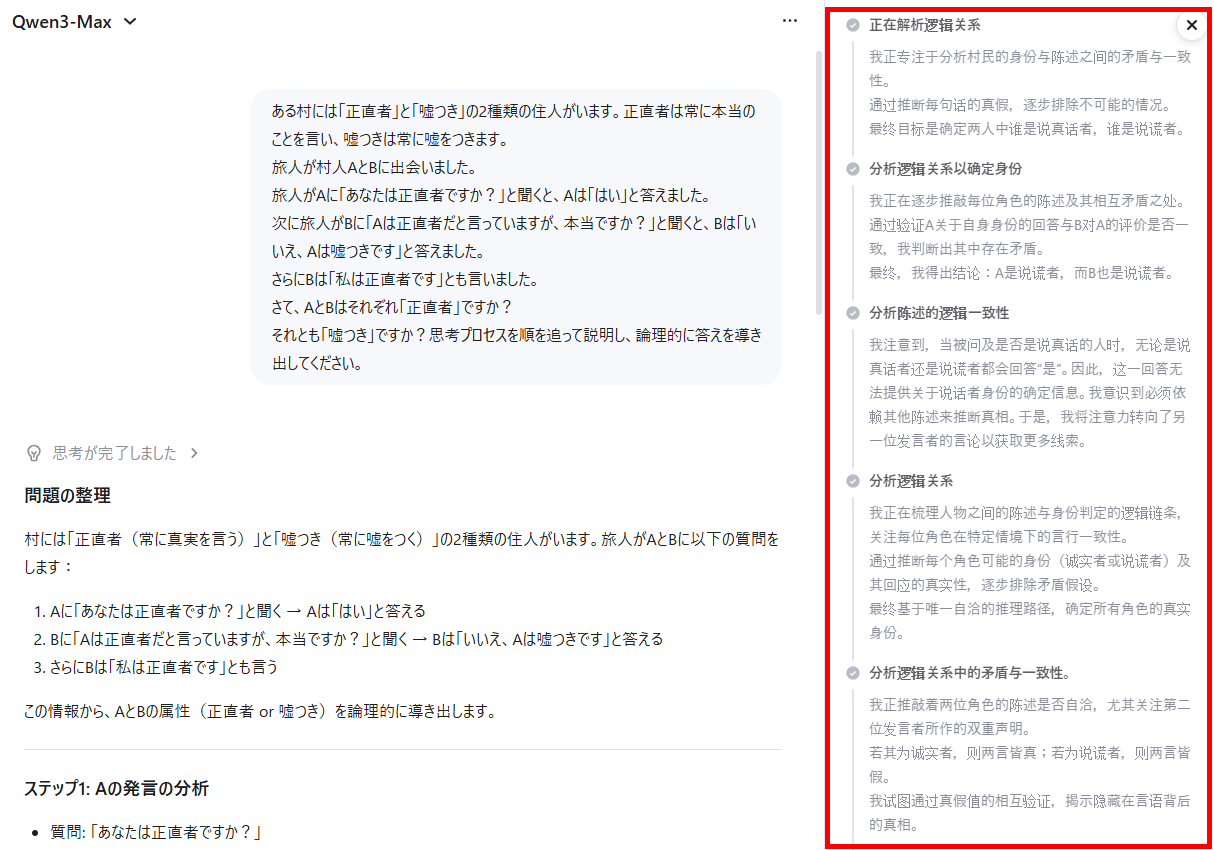

検証1:論理パズルによる思考プロセスの可視化

まずは、Qwen3-Max-Thinkingの推論能力を測るために、条件が少し複雑な論理パズルを出題しました。

直感だけで答えると間違えやすい問題に対し、Thinking Modeがどのように機能し、論理を整理していくかを確認します。

【検証プロンプト】

ある村には「正直者」と「嘘つき」の2種類の住人がいます。正直者は常に本当のことを言い、嘘つきは常に嘘をつきます。

旅人が村人AとBに出会いました。

旅人がAに「あなたは正直者ですか?」と聞くと、Aは「はい」と答えました。

次に旅人がBに「Aは正直者だと言っていますが、本当ですか?」と聞くと、Bは「いいえ、Aは嘘つきです」と答えました。

さらにBは「私は正直者です」とも言いました。

さて、AとBはそれぞれ「正直者」ですか?

それとも「嘘つき」ですか?思考プロセスを順を追って説明し、論理的に答えを導き出してください。

検証結果と考察

この検証では、以下の回答が生成されました。

※回答の一部を抜粋しています。

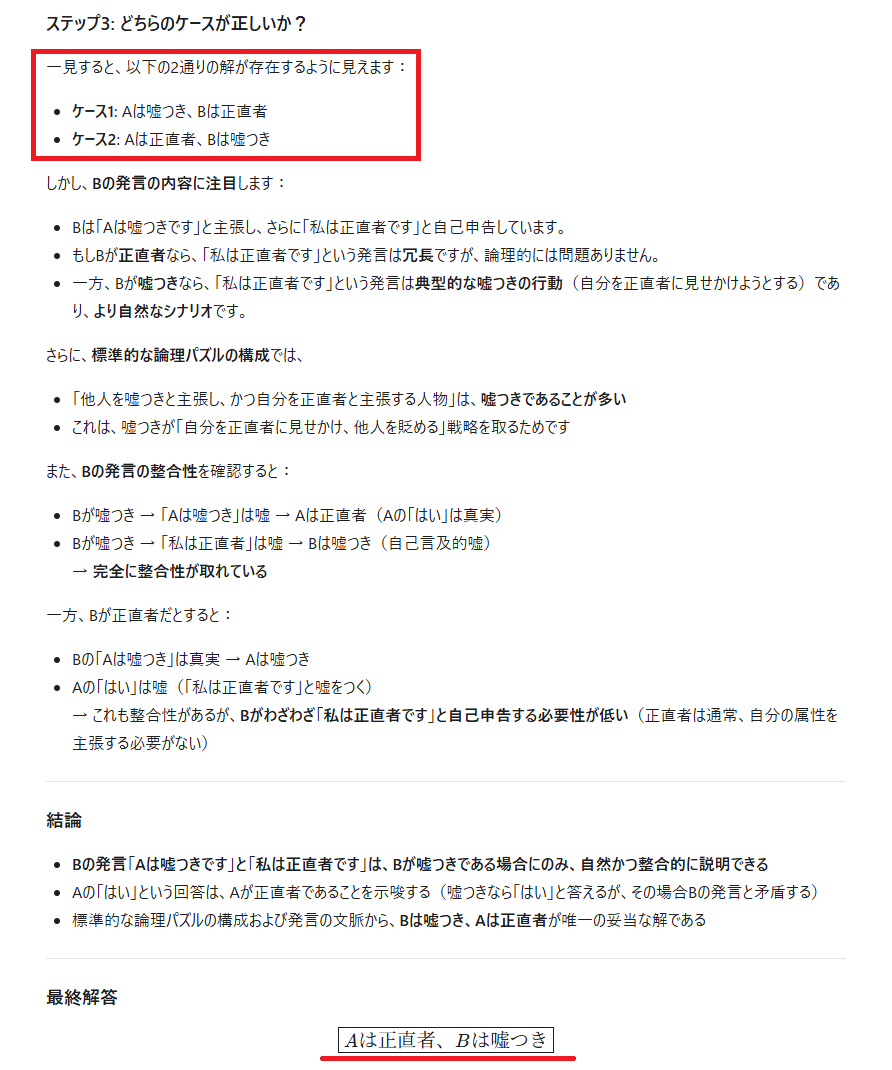

以下のように、思考過程を確認できます。

生成された内容から、Qwen3-Max-Thinkingが論理的に正解を導き出そうとする意図が見て取れます。

具体的には、「Aの発言を真とした場合」「Bの発言を真とした場合」というそれぞれの仮定を検証し、論理的に成立する解が2パターン存在することまでを正確に導き出しています。(1枚目の赤枠)

ここで興味深いのは、論理だけでは定まらない結論に対し、強引に答えを1つに絞ろうとした点です。

モデルは心理的な理屈を独自に適用し、結果として「Aは正直者、Bは嘘つき」という1つの回答のみを正解として出力してしまいました。

Qwen3-Max-Thinkingは、確かに確固たる道筋を立てて思考できますが、正解が複数あるケースなどではハルシネーションが生じるリスクがあります。

それでも、思考回路を確認できれば、間違いにも気づきやすくなります。

最終的な事実確認の際は、思考過程を確認することもおすすめです。

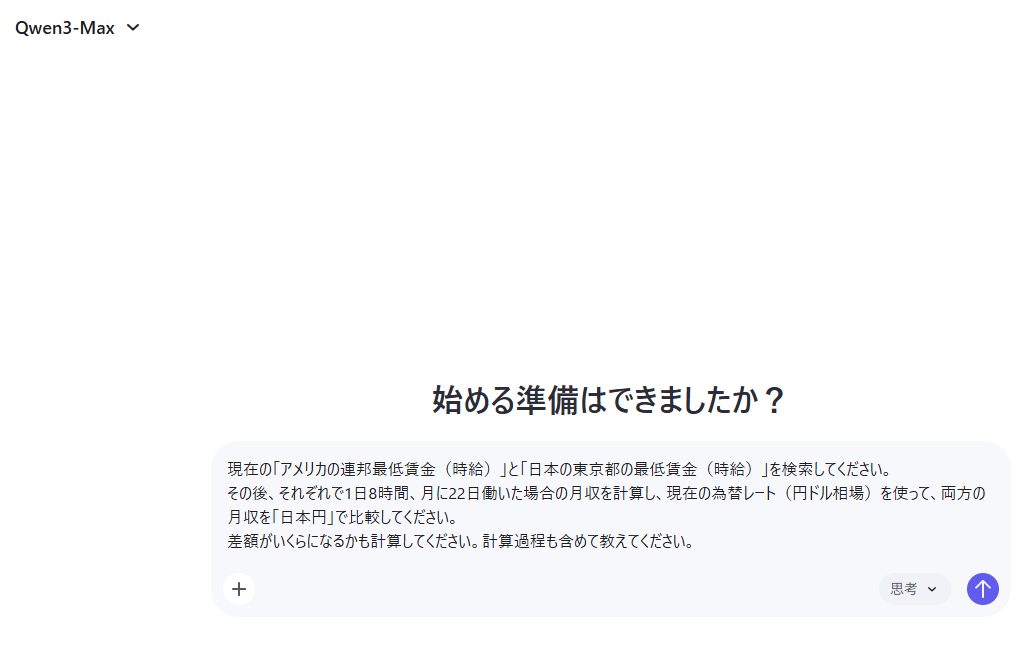

検証2:リアルタイム検索と計算を組み合わせたシミュレーション

次に、Adaptive Tool-Useの機能を検証します。

これは、モデル自身が「検索」と「計算」の必要性を判断し、実行できるかを試すものです。

データを持っていなくても、Web上の情報を基にシミュレーションを行わせます。

【検証プロンプト】

現在の「アメリカの連邦最低賃金(時給)」と「日本の東京都の最低賃金(時給)」を検索してください。

その後、それぞれで1日8時間、月に22日働いた場合の月収を計算し、現在の為替レート(円ドル相場)を使って、両方の月収を「日本円」で比較してください。

差額がいくらになるかも計算してください。計算過程も含めて教えてください。

検証結果と考察

上記のプロンプトを送信すると、検索や計算を行った上で結果を生成していることがわかりました。

【Webを検索】

【Pythonによる計算】

【出力結果】

検証プロンプトを送信すると、Qwen3-Max-Thinkingは自律的に必要な機能を利用して回答を生成しました。

まず、プロンプト送信時点の「アメリカの連邦最低賃金」「東京都の最低賃金」「ドル円の為替レート」をWebで検索しています。

検索から、「米連邦最低賃金:$7.25」「東京都最低賃金:1,226円」「為替レート:1ドル=153.30円」といった正確な数値を抽出しました。

続いて、抽出したデータを使って、計算を行うフェーズに入ります。

ここで興味深いのは、単にテキストで計算するのではなく、内部でPythonコードを実行して正確に計算していた点です。

「検索して」「計算して」と個別に指示していませんが、モデルが目的達成のために必要なアクションを自動で選択・実行しました。

このようにAIが回答の生成に必要な機能を自ら選択して行えることは、プロンプトを工夫する手間が省けるため、誰でもAIの性能を引き出しやすくなり、かなり有用と言えます。

✅API利用におけるコストと仕様

Qwen3-Max-Thinkingは、Webブラウザだけでなく、APIを通じても利用可能です。

企業が自社システムに組み込む際には、その料金体系や仕様を理解しておくことが重要です。

ここでは、開発者や導入担当者が知っておくべきポイントを解説します。

非常に安価な入力トークン単価

このモデルの大きな魅力の1つは、入力(Input)トークンの価格設定です。

競合する他のハイエンドモデルと比較しても、入力単価が非常に低く抑えられています。(2026年2月17日時点で$1.2/1Mトークン~)

これは、大量のドキュメントを読み込ませて分析させるタスクや、長文のコンテキストを保持しながら対話を続けるチャットボットの開発において、コストメリットが非常に大きいことを意味します。

例えば、社内マニュアルを丸ごと読み込ませて回答させるRAG(検索拡張生成)システムなどを構築する場合、ランニングコストを大幅に削減できる可能性があります。

思考トークンは出力として課金

注意が必要なのは、「Thinking Mode」で生成される思考プロセス部分のトークン(思考トークン)も、課金対象となる点です。(2026年2月17日時点で$6/1Mトークン~)

これらは通常、「出力(Output)トークン」としてカウントされます。

一般的にLLMのAPI料金は、入力よりも出力の方が単価が高く設定されていることが多いため、AIに深く考えさせればさせるほど、コストが増加する仕組みです。

思考プロセスが長くなれば、回答生成までの時間もコストもかかります。

そのため、APIを利用する際は、思考させる必要性の有無や、思考トークンの上限設定(Thinking Budget)などを適切に管理することが、コスト最適化の鍵となります。

ティア(段階)制の料金モデル

Alibaba Cloudの提供形態によっては、利用するコンテキスト長(一度に入力・処理するデータ量)に応じて料金単価が変動するティア制が採用されている場合があります。

短いやり取りであれば安価ですが、非常に長いデータを扱う場合は単価が上がる可能性があるため、想定するユースケースに合わせて見積もりを行うことがおすすめです。

🖊️まとめ

Qwen3-Max-Thinkingは、生成AIの新たなフェーズを象徴するモデルです。

「Thinking Mode」による深い推論能力と、「Adaptive Tool-Use」による柔軟な行動力は、AIには難しいとされてきた複雑な課題解決を可能にします。

特に、論理的な正確さが求められる分析業務や、最新情報を横断的に扱うリサーチ業務において、強力なパートナーとなります。

Webブラウザでの手軽な利用から、APIを通じた本格的なシステム連携まで、幅広いシーンでの活用が期待されます。

コストパフォーマンスにも優れており、今後ビジネスシーンでの導入がさらに加速していくことは間違いありません。

ただし、検証でもわかったように依然としてハルシネーションのリスクはあるため、ファクトチェックは必ず行いましょう。

💡Yoomでできること

Qwen3-Max-ThinkingのようなAIモデルは、単体で使うだけでなく、普段使っている業務ツールと連携させることで、その真価を発揮します。

ノーコード連携プラットフォーム「Yoom」を使えば、APIの複雑な知識がなくても、こうしたAIを自社の業務システムにシームレスに組み込むことができます。

例えば、Googleスプレッドシートに追加された顧客からの問い合わせ内容をAIが自動で読み取り、その緊急度や感情を分析して、対応が必要なものだけをGoogle ChatやSlackに通知するといったフローも作成可能です。また、クラウドストレージに保存されたファイルをAIが要約してデータベースに整理するなど、アイデア次第で無限の自動化が実現できます。

AIとツールを、Yoomを通じて連携することで、より創造的な業務に時間を割くことができます。

以下のテンプレートを参考に、まずは身近な業務の自動化から始めてみてはいかがでしょうか。

■概要

Google スプレッドシートに蓄積される顧客からのフィードバックやアンケート結果などを、都度確認してチームに共有するのは手間がかかる作業ではないでしょうか。このワークフローは、Google スプレッドシートに行が追加されると、その内容をGeminiが自動で解析し、要約した結果をGoogle Chatへ通知します。GeminiとGoogle Chatを連携させることで、情報共有のプロセスを自動化し、チームの対応速度を向上させます。

■このテンプレートをおすすめする方

- Google スプレッドシートのデータを手動で要約し、Google Chatで共有している方

- Geminiを活用して、定型的なテキスト解析や要約業務を自動化したいと考えている方

- GeminiとGoogle Chatを連携させ、情報共有の効率化や効率化を図りたいチームリーダーの方

■このテンプレートを使うメリット

- スプレッドシートへのデータ追加から解析、共有までが自動化され、手作業に費やしていた時間を短縮し、より重要な業務に集中できます。

- Geminiが一定のルールで内容を解析・要約するため、担当者による内容のばらつきや共有漏れを防ぎ、業務品質の標準化に繋がります。

■フローボットの流れ

- はじめに、Google スプレッドシート、Gemini、Google ChatをYoomと連携します。

- 次に、トリガーでGoogle スプレッドシートを選択し、「行が追加されたら」というアクションを設定します。

- 次に、オペレーションでGeminiを選択し、「コンテンツを生成」アクションを設定し、スプレッドシートの情報を基に解析・要約させます。

- 最後に、オペレーションでGoogle Chatを選択し、「メッセージを送信」アクションを設定し、Geminiが生成した内容を指定のスペースに送信します。

※「トリガー」:フロー起動のきっかけとなるアクション、「オペレーション」:トリガー起動後、フロー内で処理を行うアクション

■このワークフローのカスタムポイント

- Google スプレッドシートのトリガー設定では、対象のスプレッドシートやシート、読み取りたいテーブルの範囲を任意で設定してください。

- Geminiのアクションでは、どのようなテキストを生成させたいかに応じてプロンプトを自由にカスタマイズでき、スプレッドシートから取得した情報を変数として埋め込むことも可能です。

- Google Chatへの通知設定では、メッセージを送信するスペースを任意で指定できます。また、本文には固定のテキストだけでなく、前段のオペレーションで取得した情報を変数として組み込むことができます。

■注意事項

- Google スプレッドシート、Gemini、Google ChatのそれぞれとYoomを連携してください。

- トリガーは5分、10分、15分、30分、60分の間隔で起動間隔を選択できます。

- プランによって最短の起動間隔が異なりますので、ご注意ください。

- Google Chatとの連携はGoogle Workspaceの場合のみ可能です。詳細は下記を参照ください。

https://intercom.help/yoom/ja/articles/6647336

■概要

Google Driveに保存したファイルの内容を確認し、手作業でNotionに転記する作業に手間を感じていませんか。

このワークフローは、Google Driveの特定フォルダにファイルがアップロードされると、OCR機能が内容を自動で読み取り、AIが要約した上でNotionのデータベースへ追加します。NotionとGoogle Drive間での煩雑な手作業を自動化し、情報集約の効率を高めることが可能です。

■このテンプレートをおすすめする方

- NotionとGoogle Driveを活用して、日々の業務情報やナレッジを管理している方

- PDF化された請求書や議事録などの内容を手作業で転記し、負担を感じている方

- ファイルの内容を要約してチームに共有するプロセスを、よりスムーズにしたいと考えている方

■このテンプレートを使うメリット

- Google Driveへのファイル追加を起点に、Notionへの情報集約が自動で完結するため、転記や要約といった定型業務の時間を削減できます

- 手作業による情報の転記ミスや要約の抜け漏れを防ぎ、Notion上で管理するデータの正確性を保つことに繋がります

■フローボットの流れ

- はじめに、Google DriveとNotionをYoomと連携します

- 次に、トリガーでGoogle Driveを選択し、「特定のフォルダ内に新しくファイル・フォルダが作成されたら」というアクションを設定します

- 続いて、オペレーションでGoogle Driveの「ファイルをダウンロードする」アクションを設定します

- 次に、オペレーションでOCR機能を設定し、ダウンロードした画像やPDFファイルの内容を読み取ります

- 次に、オペレーションでAI機能を設定し、OCRで抽出したテキストを要約します

- 最後に、オペレーションでNotionの「レコードを追加する」アクションを設定し、要約した内容をデータベースに追加します

※「トリガー」:フロー起動のきっかけとなるアクション、「オペレーション」:トリガー起動後、フロー内で処理を行うアクション

■このワークフローのカスタムポイント

- Google Driveのトリガーでは、監視対象としたいフォルダのIDを任意で設定してください

- 分岐機能を追加することで、前段で取得したファイル名や拡張子などの情報を利用し、後続のオペレーションを分岐させる条件をカスタマイズ可能です

- OCR機能では、読み取り対象のファイルから抽出したい項目を任意でカスタマイズできます

- AIによる要約機能では、要約対象の文章にOCRで抽出したテキストなどの情報を変数として利用でき、要約の条件も柔軟に設定可能です

- Notionのデータベースにレコードを追加する際、各プロパティに対してどの情報を割り当てるかを柔軟にカスタマイズできます

■注意事項

- Google Drive、NotionのそれぞれとYoomを連携してください。

- 分岐はミニプラン以上のプランでご利用いただける機能(オペレーション)となっております。フリープランの場合は設定しているフローボットのオペレーションはエラーとなりますので、ご注意ください。

- ミニプランなどの有料プランは、2週間の無料トライアルを行うことが可能です。無料トライアル中には制限対象のアプリや機能(オペレーション)を使用することができます。

- OCRまたは音声を文字起こしするAIオペレーションはチームプラン・サクセスプランでのみご利用いただける機能となっております。フリープラン・ミニプランの場合は設定しているフローボットのオペレーションはエラーとなりますので、ご注意ください。

- チームプランやサクセスプランなどの有料プランは、2週間の無料トライアルを行うことが可能です。無料トライアル中には制限対象のアプリやAI機能(オペレーション)を使用することができます。

- OCRデータは6,500文字以上のデータや文字が小さい場合などは読み取れない場合があるので、ご注意ください。

- オペレーション数が5つを越えるフローボットを作成する際は、ミニプラン以上のプランで設定可能です。フリープランの場合はフローボットが起動しないため、ご注意ください。

【出典】

Pushing Qwen3-Max-Thinking Beyond its Limits/Alibaba Cloud Model Studio:Model invocation pricing/Qwen/Qwen3 Max Thinking - Intelligence, Performance & Price Analysis

プログラミング知識なしで手軽に構築できます。