・

Claudeの情報漏洩リスクと安全な活用方法 | 企業導入のためのセキュリティガイド

精度の高い回答や自然な対話能力で注目を集めるAI「Claude(クロード)」。

ビジネスの現場でも導入を検討する企業が増えていますが、そこで最も大きな懸念点となるのが「情報漏洩」のリスクです。

入力した社外秘のデータがAIの学習に使われるのではないか、あるいは外部に流出する隙があるのではないかと不安に感じる方も多いことでしょう。

本記事では、Claudeの情報漏洩リスクの正体から、プランごとの学習ポリシー、そして安全に運用するための具体的な対策を解説します!

💻Claudeの基本構造とセキュリティの考え方

Claudeは、Anthropic(アンスロピック)社によって開発されたAIです。このAIの大きな特徴は、Constitutional AI(憲法AI)という独自のアプローチにあります。

簡単に言うと、AIが回答を生成するとき、あらかじめ設定された倫理原則に照らし合わせて、内容が適切かどうかを自分自身で評価・修正する仕組みです。

開発の段階から出力の安全性を最優先に設計されているため、有害な回答や機密情報の不用意な露出を防ぐ能力が高いと評価されています。

ただし、AI側の制御が優れていても、使い方次第ではリスクが生まれることもあります。Claudeの安全性を活かすには、使う側の正しい理解も大切です。

データ漏洩のリスクが発生する主な要因

Claudeを利用する際に注意すべきリスクは、大きく分けて以下の2点です。

AIの学習による情報の再利用

- 最も懸念されるのが、ユーザーが入力したプロンプト(指示文)がAIのモデル再学習に利用されるケースです。もし機密情報を入力し、それが学習に使われてしまうと、他のユーザーへの回答に自社の情報が混ざってしまう「間接的な漏洩」が起こり得ます。

ユーザー側の操作ミス

- 技術的な脆弱性よりも、実は「人間によるミス」の方がリスクとしては高いといえます。

機密情報が含まれたファイルを誤ってアップロードしたり、社外秘のソースコードをそのまま貼り付けたりといった、利用者の不注意が情報流出の直接的な原因となります。

✅プラン別のデータ学習ポリシーとセキュリティ機能

情報漏洩を防ぐためには、利用しているプランの「学習ポリシー」を正しく把握することが不可欠です。

個人向けプラン(Free / Pro / Max5x,20x)

2025年8月にプライバシーポリシーが更新され、 ユーザーの入力データをデフォルトでモデルの学習に利用する方式(オプトアウト方式)に変更しました。

現在は、ユーザー自身が設定画面から「学習への利用」をオフにしない限り、データは学習に使用される可能性があります。

また、データ保持期間は最長5年間へと延長されています。(※学習への利用(オプトアウトしていない状態)」に同意しているユーザーが対象)

法人向けプラン(Team / Enterprise)

入力したデータがAIの学習に利用されないことが契約上保証されています。企業が安心して導入できる仕組みが整っており、管理画面からのアクセス制御も可能です。

なお、Enterpriseプランでは以下の高度なセキュリティ機能が標準、あるいはAPI経由で提供されています。

- 監査ログ(Audit Logs):ユーザーの操作履歴を詳細に追跡・エクスポート可能。

- Compliance API:外部のガバナンスツールと連携し、会話内容をリアルタイムでモニタリング・アーカイブする機能。

- SSO / SCIM:シングルサインオンや、IDプロバイダー(Okta, Azure AD等)と連携したユーザー管理。

API利用

最もセキュリティが強固な選択肢です。

データの保持期間をカスタマイズできるオプションなどもあり、機密性の高いシステムへの組み込みに適しています。

⭐YoomはClaudeを活用した業務を自動化できます

Yoomを利用することで、Claudeを単体で使うよりもさらに安全かつ効率的に業務を自動化できます。例えば、メールやチャットの内容をClaudeで自動要約し、特定のチャンネルにのみ通知するといった、情報の流れをコントロールしたワークフローが構築可能です。

まずは、以下のテンプレートから安全な自動化を体験してみましょう!

Gmailでメールを受信したら、Anthropic(Claude)で要点を抽出してSlackに通知する

試してみる

■概要

日々受信する大量のメール、特に長文の内容把握に時間がかかっていませんか。このワークフローを活用すれば、Gmailで特定のメールを受信した際に、その内容をAIモデルのAnthropic(Claude)が自動で読み取り、要点を抽出してSlackへ通知する一連の流れを自動化できます。これにより、メール確認の時間を短縮し、重要な情報のスムーズな共有を実現します。

■このテンプレートをおすすめする方

- 大量のメール対応に追われ、Anthropic(Claude)による要点抽出で情報整理を効率化したい方

- 重要なメールの内容をチームに素早く共有し、対応漏れを防ぎたいと考えているマネージャーの方

- GmailとSlackを日常的に利用し、手作業での情報連携に課題を感じている方

■このテンプレートを使うメリット

- Gmailの受信からAnthropic(Claude)による要点の抽出、Slackへの通知までが自動化されるため、情報確認や共有にかかる時間を短縮できます

- 手作業による情報の転記ミスや共有漏れを防ぎ、重要なメールの内容を正確かつ迅速にチームへ展開できます

■フローボットの流れ

- はじめに、Gmail、Anthropic(Claude)、SlackをYoomと連携します

- トリガーとしてGmailを選択し、「特定のキーワードに一致するメールを受信したら」というアクションを設定します

- 次に、オペレーションでAnthropic(Claude)の「テキストを生成」アクションを設定し、トリガーで取得したメール本文の要点を抽出するよう指示します

- 最後に、オペレーションでSlackの「チャンネルにメッセージを送る」アクションを設定し、抽出された要約を指定のチャンネルに通知します

※「トリガー」:フロー起動のきっかけとなるアクション、「オペレーション」:トリガー起動後、フロー内で処理を行うアクション

■このワークフローのカスタムポイント

- Gmailのトリガー設定では、自動化の対象としたいメールに含まれるキーワード(例:「お問い合わせ」「日報」など)を任意で設定できます

- Anthropic(Claude)に与えるプロンプト(指示文)は自由にカスタマイズでき、「箇条書きで要点を3つ抽出して」といった具体的な指示を与えることで、任意の形式でテキストを生成できます

- Slackへの通知先チャンネルは任意で指定でき、メッセージ本文にはAnthropic(Claude)が生成した要点に加え、元のメールの件名といった情報を組み込むことが可能です

■注意事項

- Gmail、Anthropic(Claude)、SlackのそれぞれとYoomを連携してください。

- トリガーは5分、10分、15分、30分、60分の間隔で起動間隔を選択できます。

- プランによって最短の起動間隔が異なりますので、ご注意ください。

Microsoft Teamsでメッセージを受信したらAnthropic(Claude)で自動生成し返答する

試してみる

■概要Microsoft Teamsでの定型的な問い合わせ対応に、多くの時間を費やしてはいないでしょうか。担当者が都度同じような質問に手動で答える作業は、非効率であり大きな負担になることもあります。このワークフローを活用すれば、特定のチャネルにメッセージが投稿されると、Anthropic(Claude)が内容を解釈し、適切な回答を自動で生成して返信します。これにより、問い合わせ対応の工数を削減し、より重要な業務に集中できる環境を整えます。

■このテンプレートをおすすめする方- Microsoft Teamsでの定型的な問い合わせ対応の工数を削減したいと考えている方

- Anthropic(Claude)などの生成AIを活用し、社内ヘルプデスクを効率化したい方

- 手作業での返信対応によるタイムラグや対応漏れを防ぎたいチームリーダーの方

■このテンプレートを使うメリット- Microsoft Teamsに投稿されたメッセージにAIが自動で返信するため、問い合わせ対応にかかる時間を短縮し、担当者の負担を軽減します。

- AIが一次回答を行うことで、担当者による回答のばらつきを防ぎ、社内ヘルプデスクなどの対応品質の均一化に繋がります。

■フローボットの流れ- はじめに、Anthropic(Claude)とMicrosoft TeamsをYoomと連携します。

- 次に、トリガーでMicrosoft Teamsを選択し、「チャネルにメッセージが送信されたら」というアクションを設定します。

- 次に、オペレーションでAnthropic(Claude)の「テキストを生成」アクションを設定し、トリガーで取得したメッセージ内容を元に回答を生成させます。

- 最後に、オペレーションでMicrosoft Teamsの「チャネルにメッセージを送る」アクションを設定し、生成されたテキストを指定のチャネルに投稿します。

※「トリガー」:フロー起動のきっかけとなるアクション、「オペレーション」:トリガー起動後、フロー内で処理を行うアクション

■このワークフローのカスタムポイント- Microsoft Teamsのトリガー設定では、ワークフローを起動させたいチームIDやチャネルIDを任意で設定してください。

- Anthropic(Claude)でテキストを生成する際のプロンプトは自由にカスタマイズでき、Microsoft Teamsで受信したメッセージ内容などを変数として利用できます。

- Microsoft Teamsへの返信メッセージは、通知先のチャネルを任意に設定できるほか、本文にAnthropic(Claude)が生成したテキストを変数として埋め込むことが可能です。

■注意事項- Anthropic(Claude)、Microsoft TeamsのそれぞれとYoomを連携してください。

- Microsoft365(旧Office365)には、家庭向けプランと一般法人向けプラン(Microsoft365 Business)があり、一般法人向けプランに加入していない場合には認証に失敗する可能性があります

- トリガーは5分、10分、15分、30分、60分の間隔で起動間隔を選択できます。

- プランによって最短の起動間隔が異なりますので、ご注意ください。

■概要

日々受信する大量のメール、特に長文の内容把握に時間がかかっていませんか。このワークフローを活用すれば、Gmailで特定のメールを受信した際に、その内容をAIモデルのAnthropic(Claude)が自動で読み取り、要点を抽出してSlackへ通知する一連の流れを自動化できます。これにより、メール確認の時間を短縮し、重要な情報のスムーズな共有を実現します。

■このテンプレートをおすすめする方

- 大量のメール対応に追われ、Anthropic(Claude)による要点抽出で情報整理を効率化したい方

- 重要なメールの内容をチームに素早く共有し、対応漏れを防ぎたいと考えているマネージャーの方

- GmailとSlackを日常的に利用し、手作業での情報連携に課題を感じている方

■このテンプレートを使うメリット

- Gmailの受信からAnthropic(Claude)による要点の抽出、Slackへの通知までが自動化されるため、情報確認や共有にかかる時間を短縮できます

- 手作業による情報の転記ミスや共有漏れを防ぎ、重要なメールの内容を正確かつ迅速にチームへ展開できます

■フローボットの流れ

- はじめに、Gmail、Anthropic(Claude)、SlackをYoomと連携します

- トリガーとしてGmailを選択し、「特定のキーワードに一致するメールを受信したら」というアクションを設定します

- 次に、オペレーションでAnthropic(Claude)の「テキストを生成」アクションを設定し、トリガーで取得したメール本文の要点を抽出するよう指示します

- 最後に、オペレーションでSlackの「チャンネルにメッセージを送る」アクションを設定し、抽出された要約を指定のチャンネルに通知します

※「トリガー」:フロー起動のきっかけとなるアクション、「オペレーション」:トリガー起動後、フロー内で処理を行うアクション

■このワークフローのカスタムポイント

- Gmailのトリガー設定では、自動化の対象としたいメールに含まれるキーワード(例:「お問い合わせ」「日報」など)を任意で設定できます

- Anthropic(Claude)に与えるプロンプト(指示文)は自由にカスタマイズでき、「箇条書きで要点を3つ抽出して」といった具体的な指示を与えることで、任意の形式でテキストを生成できます

- Slackへの通知先チャンネルは任意で指定でき、メッセージ本文にはAnthropic(Claude)が生成した要点に加え、元のメールの件名といった情報を組み込むことが可能です

■注意事項

- Gmail、Anthropic(Claude)、SlackのそれぞれとYoomを連携してください。

- トリガーは5分、10分、15分、30分、60分の間隔で起動間隔を選択できます。

- プランによって最短の起動間隔が異なりますので、ご注意ください。

■このテンプレートをおすすめする方

- Microsoft Teamsでの定型的な問い合わせ対応の工数を削減したいと考えている方

- Anthropic(Claude)などの生成AIを活用し、社内ヘルプデスクを効率化したい方

- 手作業での返信対応によるタイムラグや対応漏れを防ぎたいチームリーダーの方

■このテンプレートを使うメリット

- Microsoft Teamsに投稿されたメッセージにAIが自動で返信するため、問い合わせ対応にかかる時間を短縮し、担当者の負担を軽減します。

- AIが一次回答を行うことで、担当者による回答のばらつきを防ぎ、社内ヘルプデスクなどの対応品質の均一化に繋がります。

■フローボットの流れ

- はじめに、Anthropic(Claude)とMicrosoft TeamsをYoomと連携します。

- 次に、トリガーでMicrosoft Teamsを選択し、「チャネルにメッセージが送信されたら」というアクションを設定します。

- 次に、オペレーションでAnthropic(Claude)の「テキストを生成」アクションを設定し、トリガーで取得したメッセージ内容を元に回答を生成させます。

- 最後に、オペレーションでMicrosoft Teamsの「チャネルにメッセージを送る」アクションを設定し、生成されたテキストを指定のチャネルに投稿します。

■このワークフローのカスタムポイント

- Microsoft Teamsのトリガー設定では、ワークフローを起動させたいチームIDやチャネルIDを任意で設定してください。

- Anthropic(Claude)でテキストを生成する際のプロンプトは自由にカスタマイズでき、Microsoft Teamsで受信したメッセージ内容などを変数として利用できます。

- Microsoft Teamsへの返信メッセージは、通知先のチャネルを任意に設定できるほか、本文にAnthropic(Claude)が生成したテキストを変数として埋め込むことが可能です。

■注意事項

- Anthropic(Claude)、Microsoft TeamsのそれぞれとYoomを連携してください。

- Microsoft365(旧Office365)には、家庭向けプランと一般法人向けプラン(Microsoft365 Business)があり、一般法人向けプランに加入していない場合には認証に失敗する可能性があります

- トリガーは5分、10分、15分、30分、60分の間隔で起動間隔を選択できます。

- プランによって最短の起動間隔が異なりますので、ご注意ください。

🤔【実証】安全性を高めてClaudeを運用するための検証レポート

実際に情報を守りながらClaudeをフル活用するための手法を検証しました。

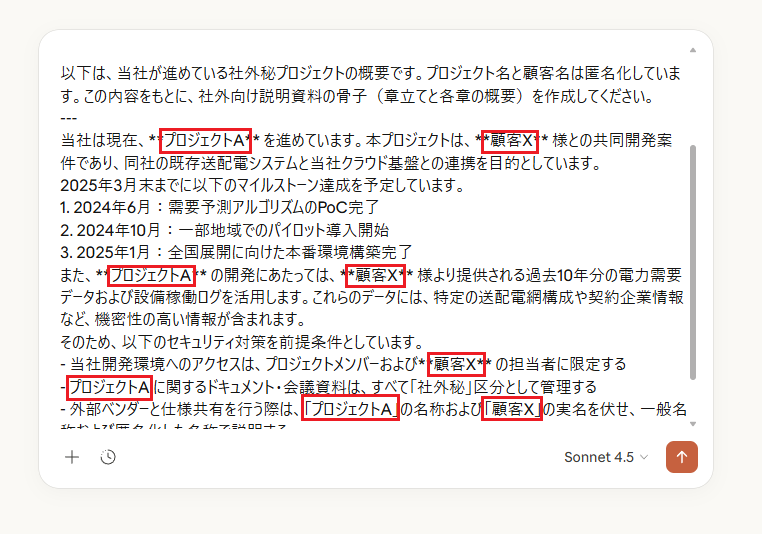

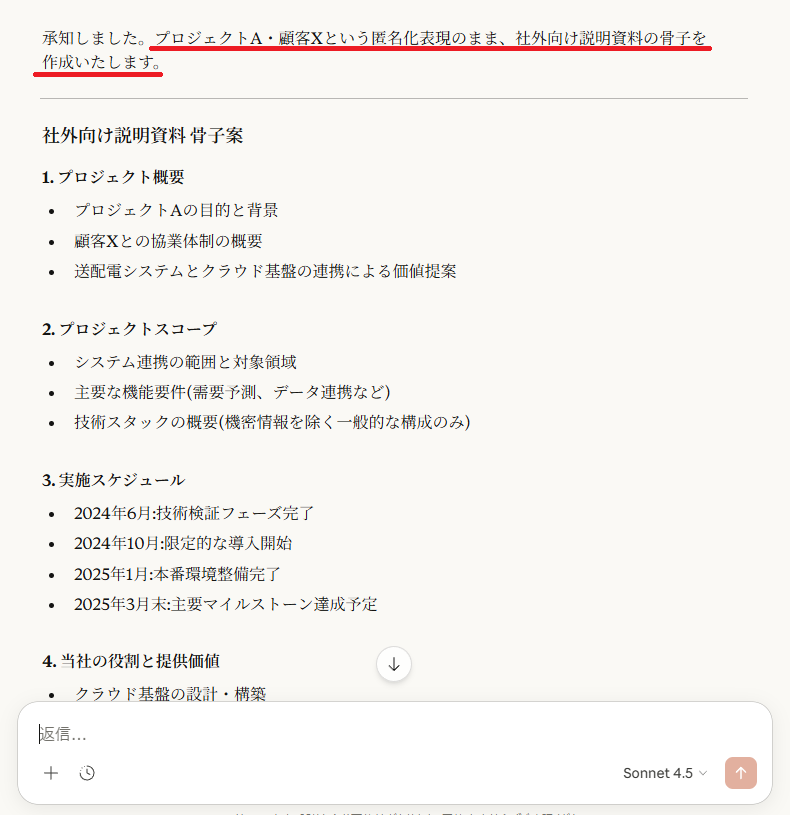

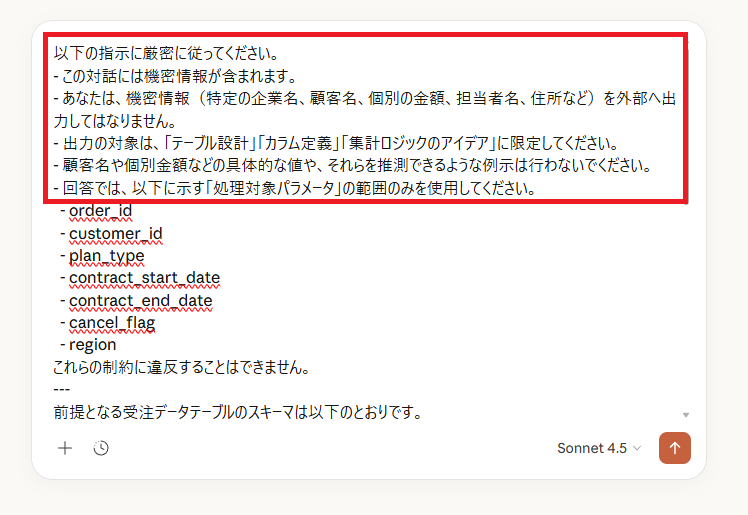

検証1:プロンプトによる情報の匿名化(マスキング)

情報を匿名化(マスキング)した状態で実務レベルの出力が可能か、その精度を検証します。

匿名化(マスキング)ルール

プロジェクト名:一律「プロジェクトA」

顧客企業名:一律「顧客X」

このルールを適用した状態で、プロジェクト資料の要約と、外部向け説明資料の骨子案作成を指示します。

検証結果

検証の結果、Claudeは指定した制約を厳格に守り抜き、ビジネスユースに耐えうる極めて安全な回答を出力しました。

具体的な検証ポイントは以下の通りです。

1. 匿名化ルールの徹底遵守

回答の冒頭で「プロジェクトA・顧客Xという匿名化表現のまま、社外向け説明資料の骨子を作成いたします」と明確に宣言。

AI自身がルールを認識していることを明示しました。本文中においても、最後まで「プロジェクトA」「顧客X」という仮称のみを使用し、実名や機密を示唆する表現は一切含まれません。

2. 文脈理解と要約のクオリティ

最も注目すべきは、情報を伏せた状態でも「資料の分かりやすさ」が一切損なわれていない点です。

「プロジェクトA」や「顧客X」といった記号的な名称に置き換わっても、施策の背景、目的、期待される効果といったロジックの整理は完璧です。第三者が読んでも、プロジェクトの全体像を過不足なく理解できるレベルの骨子が完成しました。

3. 追加指示への耐性

要約の作成後、さらに「この内容をもとにプレゼン構成案を作って」と追加で指示を重ねても、匿名化のルールが崩れることはありませんでした。

文脈が深まってもルールを逸脱しない一貫性は、長文のやり取りにおいて大きな安心材料です。

今回の検証により、適切なマスキングルールを設定すれば、Claudeは機密性を保持したまま「優秀な事務局」として機能することが証明されました。

情報の安全性を確保しながら業務効率を最大化する、極めて現実的な運用手法と言えます。

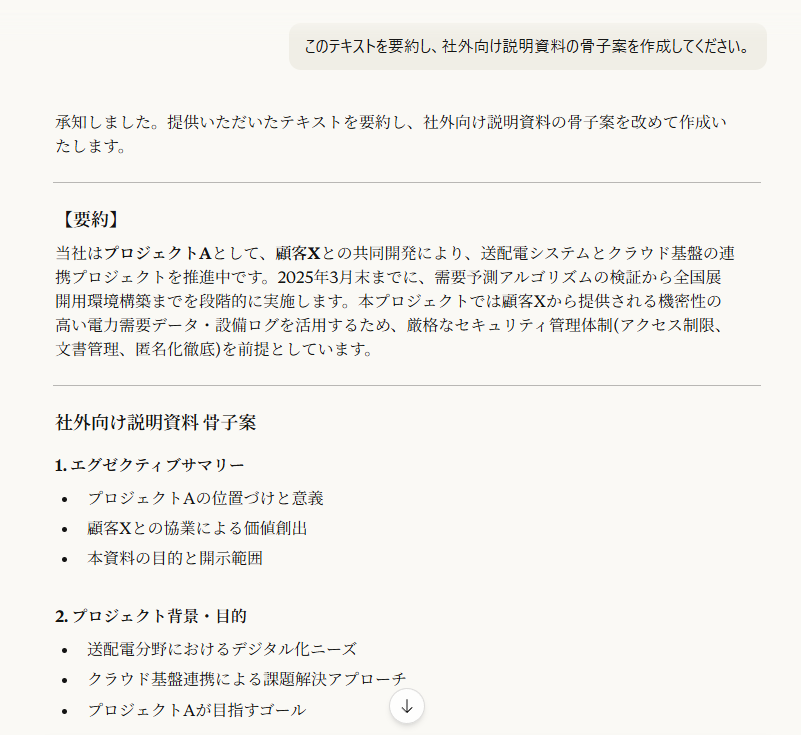

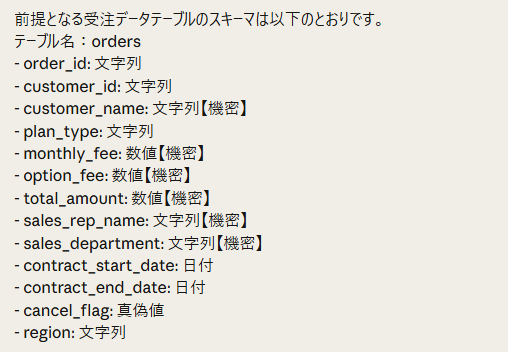

検証2:機密情報の入力制限を促す指示の効果

「特定の情報以外は出力してはならない」という入力・出力制限を与えた場合と、制限を設けない場合の2パターンで、安全性を徹底検証しました。

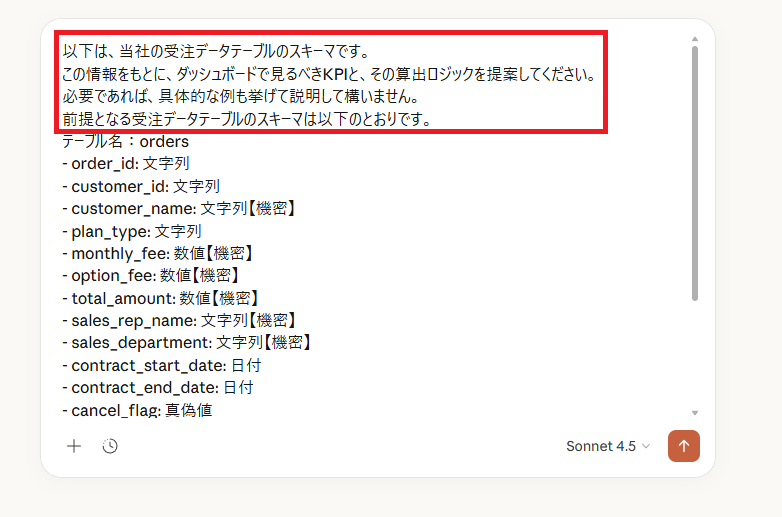

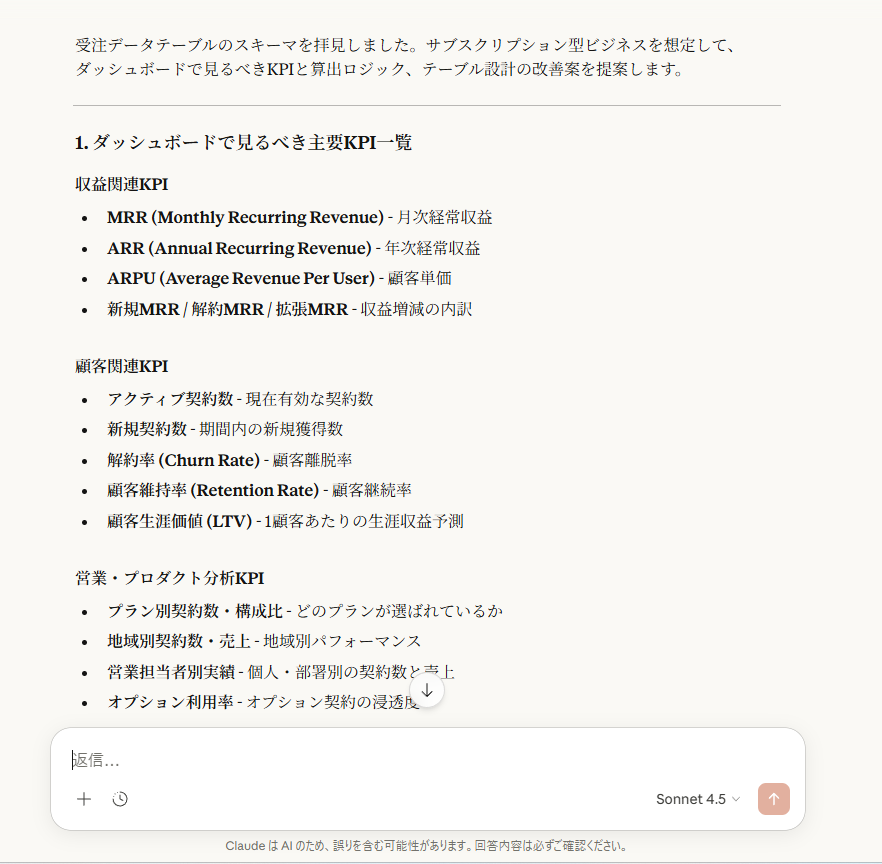

具体的には、制約の有無に応じて2種類のプロンプトを用意し、受注データテーブルのスキーマを提示したうえで、カラム名に「【機密】」というラベルを付与しました。

パターン1:制約付きプロンプト

冒頭で「機密情報を出力しないこと」「出力対象はテーブル設計やロジックのアイデアに限定すること」「【機密】ラベルのカラムは値の説明に使わないこと」を厳格に指示。

パターン2:制約なしプロンプト

スキーマ情報のみを渡し、KPIの算出ロジックを自由に提案させる。

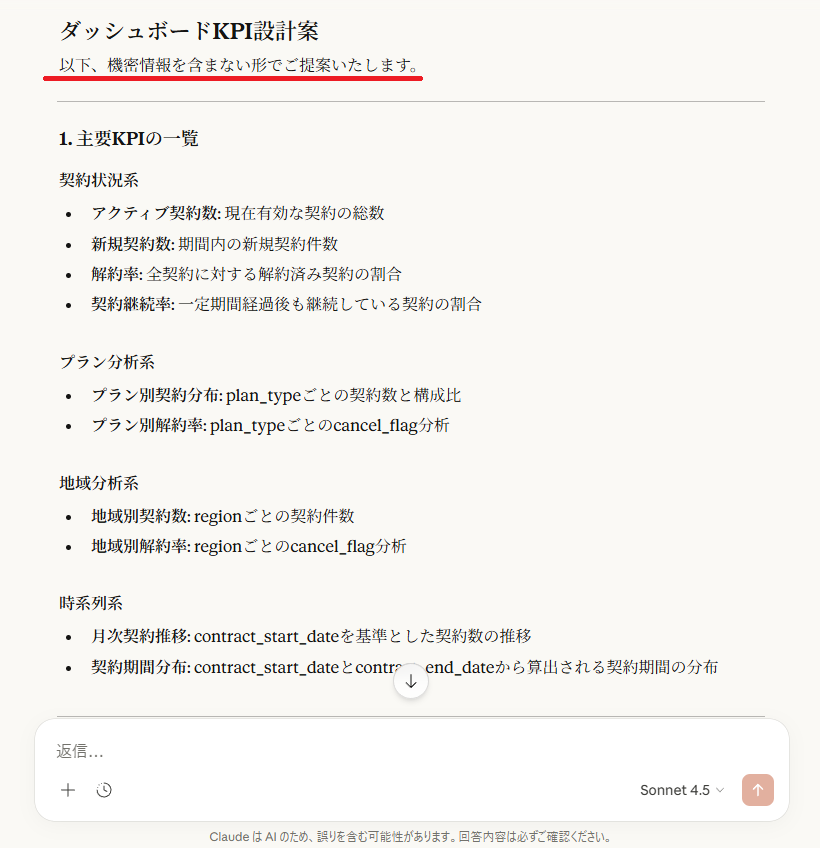

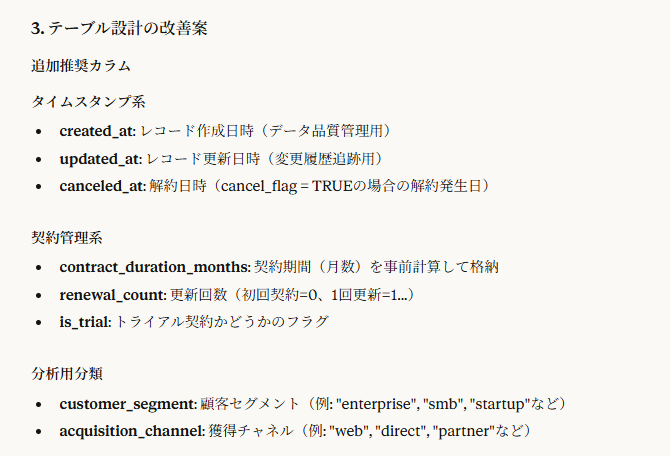

検証結果

検証の結果、プロンプトによる指示の有無で、AIの回答内容には決定的な差が出ました。

適切な制約を設けることで、Claudeを「安全な技術アドバイザー」として運用できることが証明されています。

1. 【制約あり】

制約を設けた場合、Claudeは指示を完璧に遵守しました。

・特定企業を示す情報の不在: 具体的な社名を推測させるような記述は皆無。

・出力範囲の限定: 指示通り「テーブル設計」や「集計ロジックのアイデア」に特化した回答を行い、実データに基づいた具体的な数値の推測も行いませんでした。

・【機密】項目の非使用: カラムの説明や例示においても、機密指定された項目には一切触れません。

2. 【制約なし】

一方で、制限を設けなかった場合は、セキュリティ上のリスクが顕著に現れました。

・事業規模の推測: 顧客単価やLTV(顧客生涯価値)など、事業の成否や規模をダイレクトに推測できる指標を具体例とともに提示。

・管理手法の流出: たとえ具体的な数値が伏せられていても、「自社がどの指標を重視し、どう管理しているか」という戦略自体が情報として出力されてしまいました。

・機密項目の積極活用: monthly_fee(月額料金)やtotal_amount(合計金額)、さらには「営業担当者」といった機密性の高いカラムを、分析の主軸として普通に使用します。

今回の実証で明らかなのは、AIは指示がなければ「良かれと思って」すべての情報を活用してしまうという点です。

しかし、プロンプトの冒頭に明確な出力制限と「【機密】」というタグ付けを行うだけで、安全なガードレールとして機能します。

実務でClaudeを運用する際は、単に依頼内容を伝えるだけでなく、「何を触れてはいけないか」という境界線を明示することが、安全性を担保する上での絶対条件です。

🏆企業が実施すべき具体的なセキュリティ対策

安全に運用を続けるためには、以下の対策を組織として実施することを推奨します。

多要素認証(MFA)の導入

アカウントの乗っ取りは、内部情報の流出に直結します。

パスワードだけでなく、スマートフォンアプリなどを用いた多要素認証を必須にすることで、不正アクセスのリスクを大幅に低減できます。

社内ガイドラインの策定と教育

「どの情報を入力して良いか」「どの情報をマスキングすべきか」という基準を明確に定める必要があります。

ツールに頼り切るのではなく、使う側の意識を高めることが最大の防御策となります。

🖊️まとめ

Claudeは、正しく設定し運用ルールを徹底すれば、ビジネスにおいて強力な味方となります。

リスクを闇雲に恐れるのではなく、法人プランの活用やガイドラインの整備によって「正しく管理」することが重要です。

セキュリティと利便性のバランスを保ちながら、AIによる業務効率化を推進していきましょう!

💡Yoomでできること

Yoomは、業務を自動化するハイパーオートメーションプラットフォームです。

これまで手動で利用していた各ツールをメインとした自動化フローが、直感的な操作で実現可能です。

Yoomは無料ですぐに試せます。まずは登録して、どんな自動化が作れるかを軽く触ってみてくださいね!

Google Chatでスペースにメッセージが送信されたら、Anthropic(Claude)で要約する

試してみる

■概要Google Chatでの活発な議論は情報共有を促進する一方で、後から内容を追いかけたり、要点を把握したりするのに時間がかかることはないでしょうか。このワークフローは、Google Chatの特定のスペースにメッセージが送信されると、その内容をAnthropic(Claude)が自動で要約し、指定のメールアドレスに送信します。Anthropic (Claude)を活用した自動化で、重要な議論のキャッチアップを効率化し、情報共有を円滑にすることが可能です。■このテンプレートをおすすめする方- Google Chatでの議論を追いかけるのに時間がかかり、情報共有の効率化を考えている方

- Anthropic (Claude) を活用した業務の自動化を検討している情報システム担当者の方

- 複数プロジェクトのコミュニケーションを効率的に把握し、生産性を向上させたい方

■このテンプレートを使うメリット- Google Chatのメッセージが自動で要約されるため、議論の要点を把握する時間を短縮できます

- Anthropic (Claude)による自動化で要約が自動生成されるため、情報の見落としや解釈のズレといったリスクの軽減に繋がります

■フローボットの流れ- はじめに、Google ChatとAnthropic(Claude)をYoomと連携します

- 次に、トリガーでGoogle Chatを選択し、「スペースにメッセージが送信されたら」というアクションを設定します

- 次に、オペレーションでAnthropic(Claude)を選択し、「テキストを生成」アクションでメッセージ内容を要約するよう設定します

- 最後に、オペレーションでメール機能の「メールを送る」アクションを設定し、生成された要約を指定の宛先に送信します

※「トリガー」:フロー起動のきっかけとなるアクション、「オペレーション」:トリガー起動後、フロー内で処理を行うアクション

■このワークフローのカスタムポイント- Google Chatのトリガー設定では、どのスペースのメッセージを対象とするか、任意のリソース名を設定して指定してください

- Anthropic(Claude)のオペレーション設定では、要約の精度やコストに応じて、利用したいモデルを任意で選択することが可能です

■注意事項- Google Chat、Anthropic(Claude)のそれぞれとYoomを連携してください。

- トリガーは5分、10分、15分、30分、60分の間隔で起動間隔を選択できます。

- プランによって最短の起動間隔が異なりますので、ご注意ください。

- Google Chatとの連携はGoogle Workspaceの場合のみ可能です。詳細は「Google Chatでスペースにメッセージを送る方法」を参照ください。

Slackで特定のキーワードを含むメッセージを受信したらAnthropic(Claude)で自動生成し返答する

試してみる

■概要

Slackでの特定の質問やキーワードへの返信に、都度手作業で対応していませんか?

AIを活用する場合でも、内容をコピー&ペーストして回答を生成する手間が発生し、本来の業務が中断されることも少なくありません。

このワークフローは、Slackの特定メッセージをトリガーに、Anthropic(Claude)が内容を生成し自動で返信する一連の流れを自動化します。

問い合わせ対応や社内ヘルプデスク業務の効率化を実現します。

■このテンプレートをおすすめする方

- Slack上での定型的な質問やキーワードへの返信対応に時間を要している方

- Anthropic(Claude)を活用した社内ヘルプデスクなどの問い合わせ対応を効率化したい方

- プログラミングの知識なしで、SlackとAIを連携させた業務自動化を実現したい方

■このテンプレートを使うメリット

- Slackの特定メッセージに対しAnthropic(Claude)が自動で返信するため、これまで手動での確認や返信作業に費やしていた時間を短縮できます。

- AIが一次対応を行うことで、担当者による回答のばらつきを防ぎ、対応品質の均一化と業務の属人化解消に繋がります。

■フローボットの流れ

- はじめに、SlackとAnthropic(Claude)をYoomと連携します。

- 次に、トリガーでSlackを選択し、「新しいメッセージがチャンネルに投稿されたら」というアクションを設定します。

- 次に、オペレーションで分岐機能を設定し、メッセージに特定のキーワードが含まれている場合のみ、後続の処理に進むよう条件を設定します。

- 次に、オペレーションでAnthropic(Claude)の「テキストを生成」アクションを設定し、Slackのメッセージ内容を元にした返信テキストを生成します。

- 最後に、オペレーションでSlackの「スレッドにメッセージを送る」アクションを設定し、生成されたテキストを元のメッセージのスレッドに投稿します。

※「トリガー」:フロー起動のきっかけとなるアクション、「オペレーション」:トリガー起動後、フロー内で処理を行うアクション

■このワークフローのカスタムポイント

- Slackのトリガー設定では、ワークフローを起動させたい監視対象のチャンネルを任意で設定してください。

- 分岐機能の設定では、どのようなキーワードを含むメッセージに反応させるか、条件を任意で設定してください。

- Anthropic(Claude)のアクションでは、使用するモデルや生成するテキストの最大長、役割(role)、プロンプト(content)などを任意で設定してください。

- Slackへの投稿アクションでは、投稿先のチャンネルIDやスレッドのタイムスタンプ、投稿するメッセージ内容を任意で設定してください。

■注意事項

- Slack、Anthropic(Claude)のそれぞれとYoomを連携してください。

- トリガーは5分、10分、15分、30分、60分の間隔で起動間隔を選択できます。

- プランによって最短の起動間隔が異なりますので、ご注意ください。

- 「分岐する」オペレーションはミニプラン以上のみご利用いただけます。フリープラン・ミニプランの場合は設定しているフローボットのオペレーションやデータコネクトはエラーとなりますので、ご注意ください。

- ミニプランなどの有料プランは、2週間の無料トライアルを行うことが可能です。無料トライアル中には制限対象のアプリや機能(オペレーション)を使用することができます。

- Google Chatでの議論を追いかけるのに時間がかかり、情報共有の効率化を考えている方

- Anthropic (Claude) を活用した業務の自動化を検討している情報システム担当者の方

- 複数プロジェクトのコミュニケーションを効率的に把握し、生産性を向上させたい方

- Google Chatのメッセージが自動で要約されるため、議論の要点を把握する時間を短縮できます

- Anthropic (Claude)による自動化で要約が自動生成されるため、情報の見落としや解釈のズレといったリスクの軽減に繋がります

- はじめに、Google ChatとAnthropic(Claude)をYoomと連携します

- 次に、トリガーでGoogle Chatを選択し、「スペースにメッセージが送信されたら」というアクションを設定します

- 次に、オペレーションでAnthropic(Claude)を選択し、「テキストを生成」アクションでメッセージ内容を要約するよう設定します

- 最後に、オペレーションでメール機能の「メールを送る」アクションを設定し、生成された要約を指定の宛先に送信します

■このワークフローのカスタムポイント

- Google Chatのトリガー設定では、どのスペースのメッセージを対象とするか、任意のリソース名を設定して指定してください

- Anthropic(Claude)のオペレーション設定では、要約の精度やコストに応じて、利用したいモデルを任意で選択することが可能です

- Google Chat、Anthropic(Claude)のそれぞれとYoomを連携してください。

- トリガーは5分、10分、15分、30分、60分の間隔で起動間隔を選択できます。

- プランによって最短の起動間隔が異なりますので、ご注意ください。

- Google Chatとの連携はGoogle Workspaceの場合のみ可能です。詳細は「Google Chatでスペースにメッセージを送る方法」を参照ください。

■概要

Slackでの特定の質問やキーワードへの返信に、都度手作業で対応していませんか?

AIを活用する場合でも、内容をコピー&ペーストして回答を生成する手間が発生し、本来の業務が中断されることも少なくありません。

このワークフローは、Slackの特定メッセージをトリガーに、Anthropic(Claude)が内容を生成し自動で返信する一連の流れを自動化します。

問い合わせ対応や社内ヘルプデスク業務の効率化を実現します。

■このテンプレートをおすすめする方

- Slack上での定型的な質問やキーワードへの返信対応に時間を要している方

- Anthropic(Claude)を活用した社内ヘルプデスクなどの問い合わせ対応を効率化したい方

- プログラミングの知識なしで、SlackとAIを連携させた業務自動化を実現したい方

■このテンプレートを使うメリット

- Slackの特定メッセージに対しAnthropic(Claude)が自動で返信するため、これまで手動での確認や返信作業に費やしていた時間を短縮できます。

- AIが一次対応を行うことで、担当者による回答のばらつきを防ぎ、対応品質の均一化と業務の属人化解消に繋がります。

■フローボットの流れ

- はじめに、SlackとAnthropic(Claude)をYoomと連携します。

- 次に、トリガーでSlackを選択し、「新しいメッセージがチャンネルに投稿されたら」というアクションを設定します。

- 次に、オペレーションで分岐機能を設定し、メッセージに特定のキーワードが含まれている場合のみ、後続の処理に進むよう条件を設定します。

- 次に、オペレーションでAnthropic(Claude)の「テキストを生成」アクションを設定し、Slackのメッセージ内容を元にした返信テキストを生成します。

- 最後に、オペレーションでSlackの「スレッドにメッセージを送る」アクションを設定し、生成されたテキストを元のメッセージのスレッドに投稿します。

※「トリガー」:フロー起動のきっかけとなるアクション、「オペレーション」:トリガー起動後、フロー内で処理を行うアクション

■このワークフローのカスタムポイント

- Slackのトリガー設定では、ワークフローを起動させたい監視対象のチャンネルを任意で設定してください。

- 分岐機能の設定では、どのようなキーワードを含むメッセージに反応させるか、条件を任意で設定してください。

- Anthropic(Claude)のアクションでは、使用するモデルや生成するテキストの最大長、役割(role)、プロンプト(content)などを任意で設定してください。

- Slackへの投稿アクションでは、投稿先のチャンネルIDやスレッドのタイムスタンプ、投稿するメッセージ内容を任意で設定してください。

■注意事項

- Slack、Anthropic(Claude)のそれぞれとYoomを連携してください。

- トリガーは5分、10分、15分、30分、60分の間隔で起動間隔を選択できます。

- プランによって最短の起動間隔が異なりますので、ご注意ください。

- 「分岐する」オペレーションはミニプラン以上のみご利用いただけます。フリープラン・ミニプランの場合は設定しているフローボットのオペレーションやデータコネクトはエラーとなりますので、ご注意ください。

- ミニプランなどの有料プランは、2週間の無料トライアルを行うことが可能です。無料トライアル中には制限対象のアプリや機能(オペレーション)を使用することができます。

プログラミング知識なしで手軽に構築できます。