・

【Geminiの画像認識を実務で検証】成分表示の読取や暗所での場所特定を試した

画像認識技術は日々進化していますが、Googleの生成AI「Gemini」が持つ画像認識能力は、従来のAIとは一線を画すレベルに到達しています。

「画像の内容を説明させる」だけでなく、細かい文字の読み取りや複雑な状況の推論など、ビジネス現場で即戦力となる機能が満載!

本記事では、Geminiの画像認識機能の凄さやAIが自ら画像を詳しく調査する最新のアプローチ、そして実際に使ってみた検証結果をわかりやすく解説していきます。

API価格や他のAIモデルとの違いについても触れていますので、導入を検討中の方はぜひ参考にしてくださいね!

🏃♂️➡️YoomはGeminiとの連携を自動化できます

AIとの連携は強力ですが、毎回手動で指示を出すのは手間がかかりますよね...

Yoomを活用すれば、チャットで送信された内容を解析してドキュメントに追加したり、データベースツールへの情報追加をトリガーに解析結果を通知する業務フローをノーコードで自動化できるんです!

例えば、以下のようなテンプレートを使えば、すぐに自動化を始められます。

チャットで送信された内容をGeminiで解析し、Googleドキュメントに追加する

試してみる

■概要

Slack上での活発な議論やアイデア共有は有益ですが、後から内容を追いかけたり、議事録としてまとめる作業に手間を感じていませんか。

重要な情報が流れてしまい、探すのに時間がかかることもあります。

このワークフローを活用すれば、Slackの特定チャンネルへの投稿をトリガーに、Geminiが自動で内容を解析・要約し、Googleドキュメントに追記します。情報整理の手間を解消し、ナレッジの蓄積を円滑に進めることが可能です。

■このテンプレートをおすすめする方

- Slackでの情報共有が多く、内容の振り返りや整理に課題を感じている方

- Geminiを活用して、チャットの内容から要約やタスクの抽出を自動化したい方

- 手作業での情報転記をなくし、議事録作成などの業務を効率化したいマネージャーの方

■このテンプレートを使うメリット

- Slackの投稿を自動で解析しGoogleドキュメントに記録するため、手作業での転記や要約に費やしていた時間を短縮できます。

- 手動でのコピー&ペーストによる転記漏れや、内容の抜け漏れといったヒューマンエラーの発生を防ぎ、情報の正確性を保ちます。

■フローボットの流れ

- はじめに、Slack、Gemini、GoogleドキュメントをYoomと連携します。

- 次に、トリガーでSlackを選択し、「メッセージがチャンネルに投稿されたら」というアクションを設定します。

- 次に、オペレーションでGeminiを選択し、「コンテンツを生成」アクションでSlackの投稿内容を解析・要約するよう設定します。

- 最後に、オペレーションでGoogleドキュメントを選択し、「文末にテキストを追加」アクションで、Geminiが生成した内容を指定のドキュメントに追記するよう設定します。

※「トリガー」:フロー起動のきっかけとなるアクション、「オペレーション」:トリガー起動後、フロー内で処理を行うアクション

■このワークフローのカスタムポイント

- Slackのトリガー設定では、自動化の対象としたいチャンネルを任意で選択してください。

- Geminiのオペレーション設定では、「この内容を要約して」「アクションアイテムを抽出して」など、目的に応じてプロンプトを自由にカスタマイズしてください。

- Googleドキュメントのオペレーション設定では、解析結果を追記したいドキュメントを任意で選択してください。

■注意事項

- Gemini、Googleドキュメント、SlackのそれぞれとYoomを連携してください。

Notionに行が追加されたら、Geminiで解析しGoogle Chatにメッセージを送信する

試してみる

■概要Notionに蓄積される情報を、都度確認して要約しチームに共有する作業は手間がかかるのではないでしょうか。

このワークフローは、Notionのデータソースに新しいページが追加・更新されると、その内容をGeminiが自動で解析し、要約した結果をGoogle Chatに通知します。GeminiとGoogle Chatを連携させることで、情報共有のプロセスを自動化し、手作業による確認や転記の手間を省き、チーム全体の情報共有を円滑にします。■このテンプレートをおすすめする方- Notionに集約した情報を、手作業でGoogle Chatに共有しており手間を感じている方

- GeminiとGoogle Chatを連携させ、情報共有の自動化や効率化を実現したい方

- 最新情報の確認漏れを防ぎ、チーム内の効率的な意思決定を促進したいマネージャーの方

■このテンプレートを使うメリット- Notionへの情報追加を起点にGeminiでの解析とGoogle Chatへの通知が自動化され、これまで手作業で行っていた情報共有の時間を短縮します。

- 手作業による情報の転記ミスや共有漏れを防ぎ、常に正確な情報に基づいたコミュニケーションを実現できます。

■フローボットの流れ- はじめに、Notion、Gemini、Google ChatをYoomと連携します。

- 次に、トリガーでNotionを選択し、「特定のデータソースのページが作成・更新されたら」というアクションを設定します。

- 次に、オペレーションで分岐機能を設定し、取得した情報をもとに特定の条件で後続のアクションを実行するかを判断させます。

- 次に、オペレーションでNotionの「レコードを取得する(ID検索)」を設定し、トリガーで反応したページのより詳細な情報を取得します。

- 次に、オペレーションでGeminiの「コンテンツを生成」を設定し、取得したNotionの情報を元に要約などのテキストを生成します。

- 最後に、オペレーションでGoogle Chatの「メッセージを送信」を設定し、Geminiが生成したテキストを指定のスペースに送信します。

※「トリガー」:フロー起動のきっかけとなるアクション、「オペレーション」:トリガー起動後、フロー内で処理を行うアクション■このワークフローのカスタムポイント- Notionのトリガー設定では、連携の対象としたいデータソースIDを任意で設定してください。

- 分岐機能では、Notionから取得したページのプロパティ(ステータスなど)の値を基に、後続の処理を実行する条件を自由に設定できます。

- Geminiにテキスト生成を依頼する際のプロンプトは自由にカスタマイズでき、Notionから取得した情報を変数として組み込むことで、目的に応じた文章を作成させることが可能です。

- Google Chatへの通知では、メッセージを送信するスペースを任意で指定できるだけでなく、本文にGeminiが生成した内容やNotionの情報を変数として埋め込めます。

■注意事項- Notion、Gemini、Google ChatのそれぞれとYoomを連携してください。

- トリガーは5分、10分、15分、30分、60分の間隔で起動間隔を選択できます。

- プランによって最短の起動間隔が異なりますので、ご注意ください。

- 分岐はミニプラン以上のプランでご利用いただける機能(オペレーション)となっております。フリープランの場合は設定しているフローボットのオペレーションはエラーとなりますので、ご注意ください。

- ミニプランなどの有料プランは、2週間の無料トライアルを行うことが可能です。無料トライアル中には制限対象のアプリや機能(オペレーション)を使用することができます。

- Google Chatとの連携はGoogle Workspaceの場合のみ可能です。詳細は下記を参照ください。

https://intercom.help/yoom/ja/articles/6647336

Google スプレッドシートに追加された行を元に、Geminiでテキストを生成しRedditのサブレディットに投稿する

試してみる

■概要

Redditへの定期的な投稿や、Geminiを使ったコンテンツ生成を手作業で行っていませんか?ネタの考案から投稿まで、一連の作業には多くの時間と手間がかかります。

このワークフローを活用すれば、Google スプレッドシートに投稿の元となる情報を追加するだけで、Geminiが自動でテキストを生成し、指定したRedditのサブレディットへの投稿までを自動化できます。これにより、コンテンツ投稿のプロセスを効率化し、より戦略的な活動に時間を充てることが可能になります。

■このテンプレートをおすすめする方

- Geminiを活用してRedditへの投稿コンテンツを効率的に作成したいコミュニティマネージャーの方

- Google スプレッドシートで管理している情報を元に、Redditへの投稿を自動化したいマーケターの方

- API連携の知識なしで、GeminiとRedditを連携させた情報発信の仕組みを構築したい方

■このテンプレートを使うメリット

- スプレッドシートへの追記だけでGeminiが投稿文を生成しRedditへ投稿するため、一連の作業に費やしていた時間を短縮することができます。

- 手作業によるコピー&ペーストのミスや投稿先の間違いといったヒューマンエラーを防ぎ、安定した情報発信を実現します。

■フローボットの流れ

- はじめに、Google スプレッドシート、Gemini、RedditをYoomと連携します。

- 次に、トリガーでGoogle スプレッドシートを選択し、「行が追加されたら」というアクションを設定します。

- 次に、オペレーションでGeminiを選択し、「コンテンツを生成」アクションを設定し、スプレッドシートの情報を元に投稿するテキストを作成します。

- 最後に、オペレーションでRedditの「サブレディットに新規投稿を作成」アクションを設定し、Geminiで生成したテキストを投稿します。

※「トリガー」:フロー起動のきっかけとなるアクション、「オペレーション」:トリガー起動後、フロー内で処理を行うアクション

■このワークフローのカスタムポイント

- Google スプレッドシートのトリガー設定では、対象のスプレッドシート、シート、そしてデータを取得するテーブルの範囲を任意で設定してください。

- Geminiのアクションでは、テキストを生成するためのプロンプトを自由にカスタマイズできます。スプレッドシートから取得した情報を変数としてプロンプトに含めることも可能です。

- Redditへの投稿アクションでは、投稿先のサブレディット、タイトル、本文などを任意で設定できます。固定値だけでなく、前段のフローで取得した情報を変数として利用できます。

■注意事項

- Google スプレッドシート、Gemini、RedditのそれぞれとYoomを連携してください。

- トリガーは5分、10分、15分、30分、60分の間隔で起動間隔を選択できます。

- プランによって最短の起動間隔が異なりますので、ご注意ください。

■概要

Slack上での活発な議論やアイデア共有は有益ですが、後から内容を追いかけたり、議事録としてまとめる作業に手間を感じていませんか。

重要な情報が流れてしまい、探すのに時間がかかることもあります。

このワークフローを活用すれば、Slackの特定チャンネルへの投稿をトリガーに、Geminiが自動で内容を解析・要約し、Googleドキュメントに追記します。情報整理の手間を解消し、ナレッジの蓄積を円滑に進めることが可能です。

■このテンプレートをおすすめする方

- Slackでの情報共有が多く、内容の振り返りや整理に課題を感じている方

- Geminiを活用して、チャットの内容から要約やタスクの抽出を自動化したい方

- 手作業での情報転記をなくし、議事録作成などの業務を効率化したいマネージャーの方

■このテンプレートを使うメリット

- Slackの投稿を自動で解析しGoogleドキュメントに記録するため、手作業での転記や要約に費やしていた時間を短縮できます。

- 手動でのコピー&ペーストによる転記漏れや、内容の抜け漏れといったヒューマンエラーの発生を防ぎ、情報の正確性を保ちます。

■フローボットの流れ

- はじめに、Slack、Gemini、GoogleドキュメントをYoomと連携します。

- 次に、トリガーでSlackを選択し、「メッセージがチャンネルに投稿されたら」というアクションを設定します。

- 次に、オペレーションでGeminiを選択し、「コンテンツを生成」アクションでSlackの投稿内容を解析・要約するよう設定します。

- 最後に、オペレーションでGoogleドキュメントを選択し、「文末にテキストを追加」アクションで、Geminiが生成した内容を指定のドキュメントに追記するよう設定します。

※「トリガー」:フロー起動のきっかけとなるアクション、「オペレーション」:トリガー起動後、フロー内で処理を行うアクション

■このワークフローのカスタムポイント

- Slackのトリガー設定では、自動化の対象としたいチャンネルを任意で選択してください。

- Geminiのオペレーション設定では、「この内容を要約して」「アクションアイテムを抽出して」など、目的に応じてプロンプトを自由にカスタマイズしてください。

- Googleドキュメントのオペレーション設定では、解析結果を追記したいドキュメントを任意で選択してください。

■注意事項

- Gemini、Googleドキュメント、SlackのそれぞれとYoomを連携してください。

このワークフローは、Notionのデータソースに新しいページが追加・更新されると、その内容をGeminiが自動で解析し、要約した結果をGoogle Chatに通知します。GeminiとGoogle Chatを連携させることで、情報共有のプロセスを自動化し、手作業による確認や転記の手間を省き、チーム全体の情報共有を円滑にします。

- Notionに集約した情報を、手作業でGoogle Chatに共有しており手間を感じている方

- GeminiとGoogle Chatを連携させ、情報共有の自動化や効率化を実現したい方

- 最新情報の確認漏れを防ぎ、チーム内の効率的な意思決定を促進したいマネージャーの方

- Notionへの情報追加を起点にGeminiでの解析とGoogle Chatへの通知が自動化され、これまで手作業で行っていた情報共有の時間を短縮します。

- 手作業による情報の転記ミスや共有漏れを防ぎ、常に正確な情報に基づいたコミュニケーションを実現できます。

- はじめに、Notion、Gemini、Google ChatをYoomと連携します。

- 次に、トリガーでNotionを選択し、「特定のデータソースのページが作成・更新されたら」というアクションを設定します。

- 次に、オペレーションで分岐機能を設定し、取得した情報をもとに特定の条件で後続のアクションを実行するかを判断させます。

- 次に、オペレーションでNotionの「レコードを取得する(ID検索)」を設定し、トリガーで反応したページのより詳細な情報を取得します。

- 次に、オペレーションでGeminiの「コンテンツを生成」を設定し、取得したNotionの情報を元に要約などのテキストを生成します。

- 最後に、オペレーションでGoogle Chatの「メッセージを送信」を設定し、Geminiが生成したテキストを指定のスペースに送信します。

- Notionのトリガー設定では、連携の対象としたいデータソースIDを任意で設定してください。

- 分岐機能では、Notionから取得したページのプロパティ(ステータスなど)の値を基に、後続の処理を実行する条件を自由に設定できます。

- Geminiにテキスト生成を依頼する際のプロンプトは自由にカスタマイズでき、Notionから取得した情報を変数として組み込むことで、目的に応じた文章を作成させることが可能です。

- Google Chatへの通知では、メッセージを送信するスペースを任意で指定できるだけでなく、本文にGeminiが生成した内容やNotionの情報を変数として埋め込めます。

- Notion、Gemini、Google ChatのそれぞれとYoomを連携してください。

- トリガーは5分、10分、15分、30分、60分の間隔で起動間隔を選択できます。

- プランによって最短の起動間隔が異なりますので、ご注意ください。

- 分岐はミニプラン以上のプランでご利用いただける機能(オペレーション)となっております。フリープランの場合は設定しているフローボットのオペレーションはエラーとなりますので、ご注意ください。

- ミニプランなどの有料プランは、2週間の無料トライアルを行うことが可能です。無料トライアル中には制限対象のアプリや機能(オペレーション)を使用することができます。

- Google Chatとの連携はGoogle Workspaceの場合のみ可能です。詳細は下記を参照ください。

https://intercom.help/yoom/ja/articles/6647336

■概要

Redditへの定期的な投稿や、Geminiを使ったコンテンツ生成を手作業で行っていませんか?ネタの考案から投稿まで、一連の作業には多くの時間と手間がかかります。

このワークフローを活用すれば、Google スプレッドシートに投稿の元となる情報を追加するだけで、Geminiが自動でテキストを生成し、指定したRedditのサブレディットへの投稿までを自動化できます。これにより、コンテンツ投稿のプロセスを効率化し、より戦略的な活動に時間を充てることが可能になります。

■このテンプレートをおすすめする方

- Geminiを活用してRedditへの投稿コンテンツを効率的に作成したいコミュニティマネージャーの方

- Google スプレッドシートで管理している情報を元に、Redditへの投稿を自動化したいマーケターの方

- API連携の知識なしで、GeminiとRedditを連携させた情報発信の仕組みを構築したい方

■このテンプレートを使うメリット

- スプレッドシートへの追記だけでGeminiが投稿文を生成しRedditへ投稿するため、一連の作業に費やしていた時間を短縮することができます。

- 手作業によるコピー&ペーストのミスや投稿先の間違いといったヒューマンエラーを防ぎ、安定した情報発信を実現します。

■フローボットの流れ

- はじめに、Google スプレッドシート、Gemini、RedditをYoomと連携します。

- 次に、トリガーでGoogle スプレッドシートを選択し、「行が追加されたら」というアクションを設定します。

- 次に、オペレーションでGeminiを選択し、「コンテンツを生成」アクションを設定し、スプレッドシートの情報を元に投稿するテキストを作成します。

- 最後に、オペレーションでRedditの「サブレディットに新規投稿を作成」アクションを設定し、Geminiで生成したテキストを投稿します。

※「トリガー」:フロー起動のきっかけとなるアクション、「オペレーション」:トリガー起動後、フロー内で処理を行うアクション

■このワークフローのカスタムポイント

- Google スプレッドシートのトリガー設定では、対象のスプレッドシート、シート、そしてデータを取得するテーブルの範囲を任意で設定してください。

- Geminiのアクションでは、テキストを生成するためのプロンプトを自由にカスタマイズできます。スプレッドシートから取得した情報を変数としてプロンプトに含めることも可能です。

- Redditへの投稿アクションでは、投稿先のサブレディット、タイトル、本文などを任意で設定できます。固定値だけでなく、前段のフローで取得した情報を変数として利用できます。

■注意事項

- Google スプレッドシート、Gemini、RedditのそれぞれとYoomを連携してください。

- トリガーは5分、10分、15分、30分、60分の間隔で起動間隔を選択できます。

- プランによって最短の起動間隔が異なりますので、ご注意ください。

👀Geminiの画像認識とは?何ができる?

Geminiは、Googleが開発した「マルチモーダルAI」。

テキストだけでなく、画像や音声、動画といった異なる種類の情報をネイティブに理解することができます。

画像認識においては、単に「何が写っているか」を答えるだけでなく、以下のような高度な処理が可能です。

- 物体認識・特定:写真内の商品、動物、建物などを高精度に特定します。

-

OCR(文字認識):手書きのメモや印刷物の文字をテキストデータとして抽出可能!

日本語の読み取り精度も非常に高いのが特徴です。 - 状況説明:「この画像の人物は何をしているか?」「このグラフから何が読み取れるか?」といった、文脈を理解して説明できちゃうんです。

- 推論とアドバイス:冷蔵庫の中身の写真からレシピを提案したり、商品のパッケージ画像からターゲット層を推測したりといった活用も可能!

👐AIの認識アプローチとは?

Geminiの最新の画像認識機能における最大の特徴は、AIが人間のように「能動的に画像を見る」アプローチを取り入れている点。

従来のAIは、与えられた画像を一度だけ全体的にスキャンして回答していましたが、これでは細かい文字や密集した物体の数え上げなどでミスが発生しがちでした...

Geminiの「自律的な視覚探索機能」では、AIが画像の細部を確認する必要があると判断した場合、自ら画像を「ズーム」「切り抜き」して、対象箇所を詳しく再確認できるようになったんです!

「Think-Act-Observe」のループ

このプロセスは、AIの中で以下のような自律的なループとして実行されます。

- Think(思考):「この文字は小さくて読みにくいな。拡大して確認しよう」や「物体の数を正確に数えるためにマーキングが必要だ」とAI自身が判断できるんです!

- Act(実行):判断に基づき、実際に画像の特定部分をズーム処理したり、カウント用のマーカーを描画したりするコードを裏側で実行します。

- Observe(観察):処理後の画像を再度認識し、より正確な情報を取得して回答を生成。

この「確認プロセス」を自律的に挟むことで、小さな注釈文字の読み取りや、複雑な図面の解析精度が飛躍的に向上しています。

Google AI StudioやAPIでの活用

このアプローチは、Google AI StudioやAPIを通じたエージェント型(Agentic)ワークフローとして提供されています。

従来の画像認識APIは「画像を送って結果を受け取る」という一方通行のものでした。

エージェント型ワークフローでは、AIがタスクを完了するために必要なツール(Pythonコード実行環境など)を自律的に呼び出し、納得いくまで確認を行ってから最終回答を出力します。

開発者は複雑な指示(例:「この図面の配管の本数を数えて」など)を投げても、AIが自ら試行錯誤して精度の高い答えを導き出してくれるようになるのです!

☑️【やってみた】Geminiの画像認識力を検証

さっそく、Geminiがどのような挙動を見せるのか、3つのパターンで検証してみました!

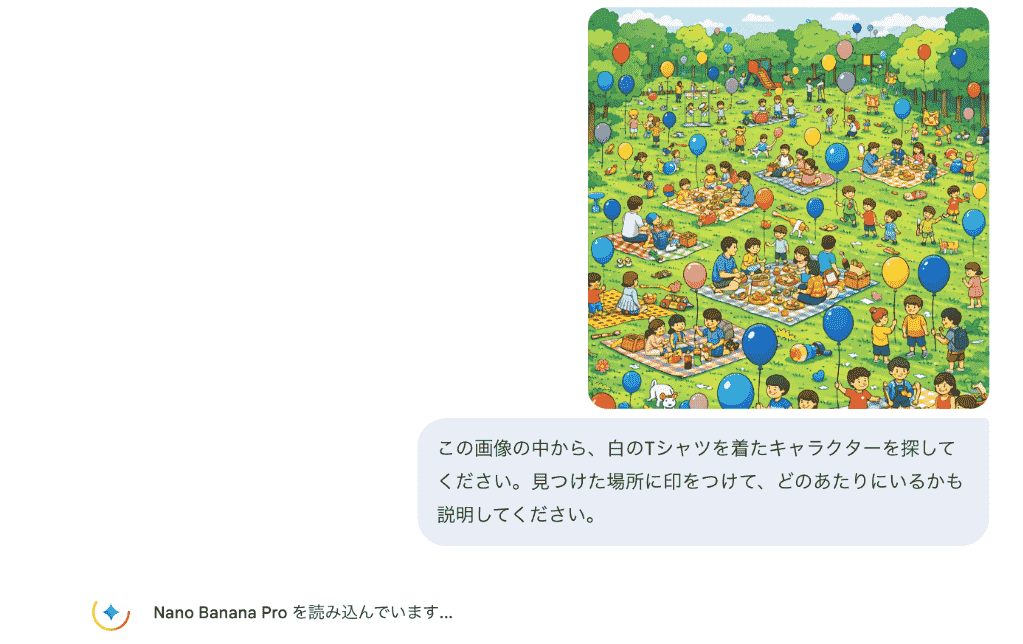

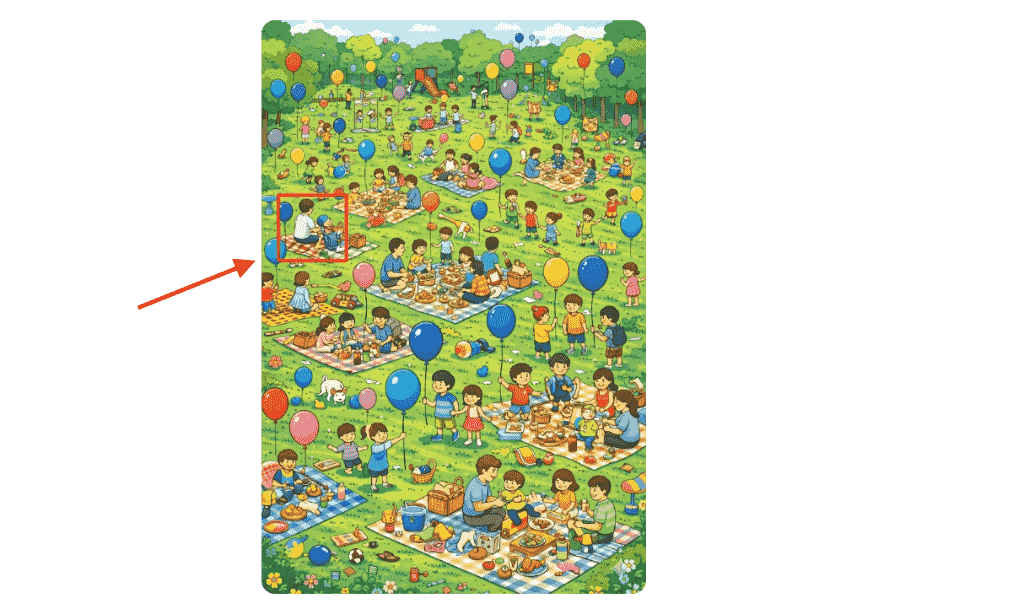

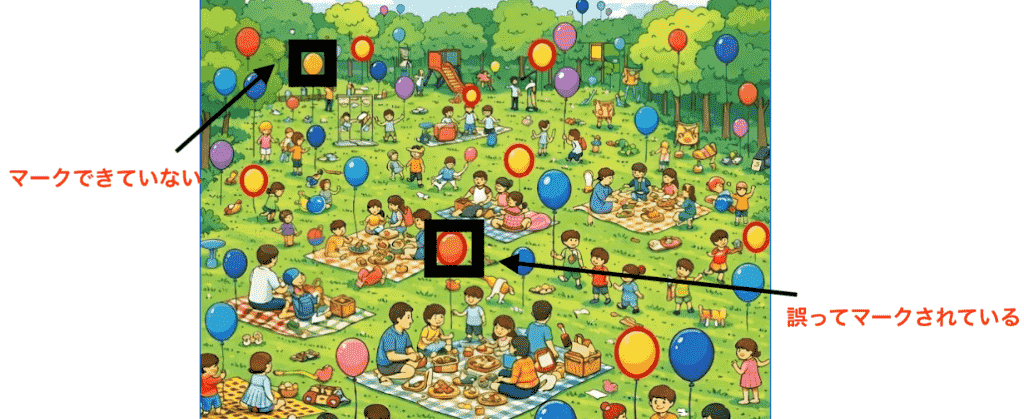

1.高難度探索

細かい物体が大量に描かれたイラストを用意し、以下のプロンプトを投稿してみます。

入力プロンプト

この画像の中から、白のTシャツを着たキャラクターを探してください。見つけた場所に印をつけて、どのあたりにいるかも説明してください。

プロンプト投稿後、「Nano Banana Proを読み込んでいます...」と表示され、解析結果が出力されました!

白い毛色の動物や薄い水色のトップスの人物もいたのですが、惑わされることもなく、対象のキャラクターがいる場所に正確に印をつけているようです!

従来モデルでは「画像の中央あたり」といった曖昧な回答になりがちでしたが、正確に位置を特定できる実力を見せつけました。

対象を変更してみましょう。

次は「黄色い風船だけに印をして」と投稿してみます。

今度は思わしい結果が得られず、マークできているものや違う色の風船をマークしているのが散見されました...

必ずしも高い精度を毎回発揮するわけではなさそうなので、やはり人の目で最終チェックを行うのが必要だと実感する結果となりました。

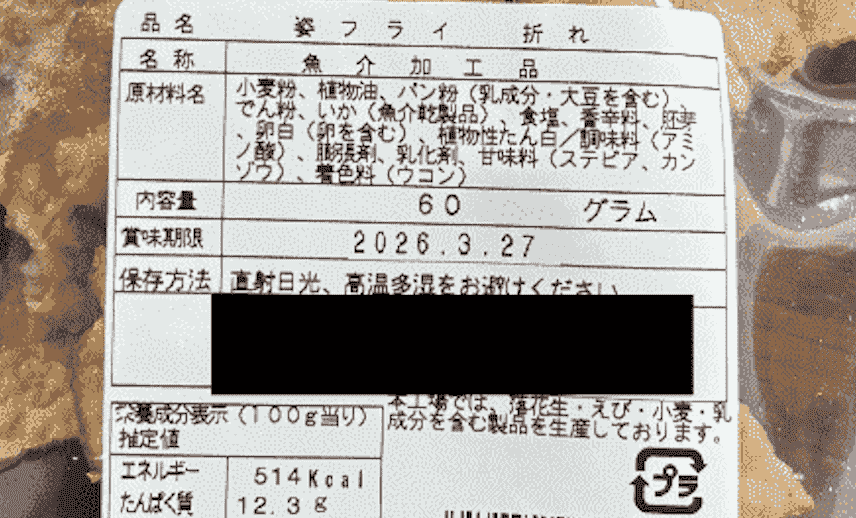

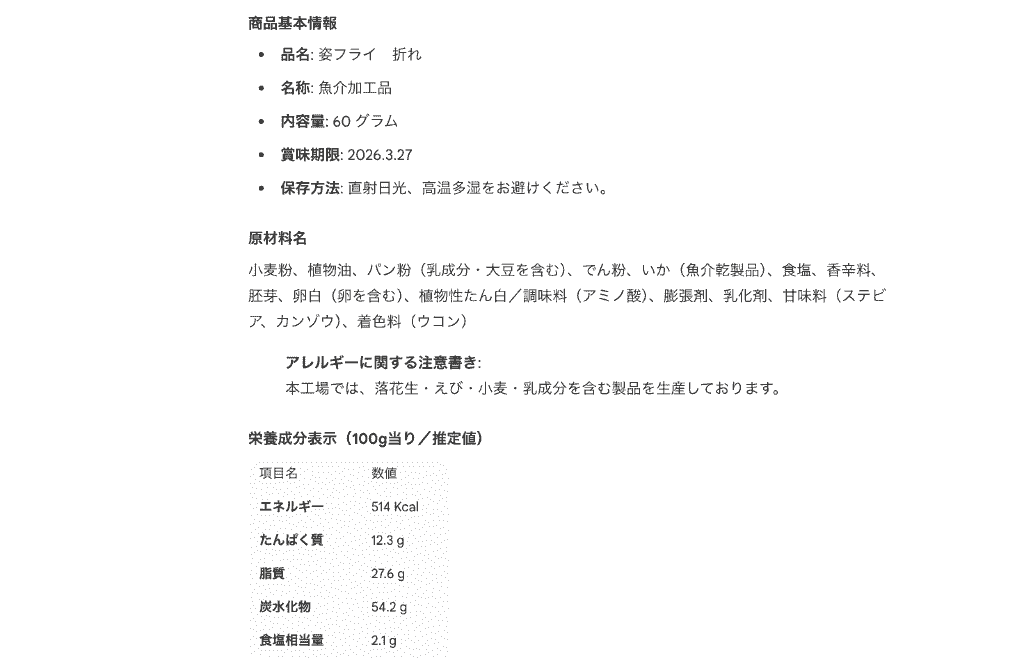

2.超・極小文字のOCR検証

次は、食品パッケージの裏面にある成分表示の画像を読ませてみました。

漢字やカタカナで記載されており、離れた距離から撮影したため字も小さいのですが、この情報を正確に読み取ってくれるでしょうか?(添付している画像は読みやすく寄ったものです)

入力プロンプト

この画像に写っている成分表示を、読み取れる範囲ですべてテキスト化してください。

特に『原材料名』『栄養成分表示』の部分を正確に読み取り、項目名と数値を一覧にしてください。

読み取り結果は以下のとおりです!

栄養成分に至っては、見やすいように表形式で出力されていますね。

漢字の読み取りも問題ありません。

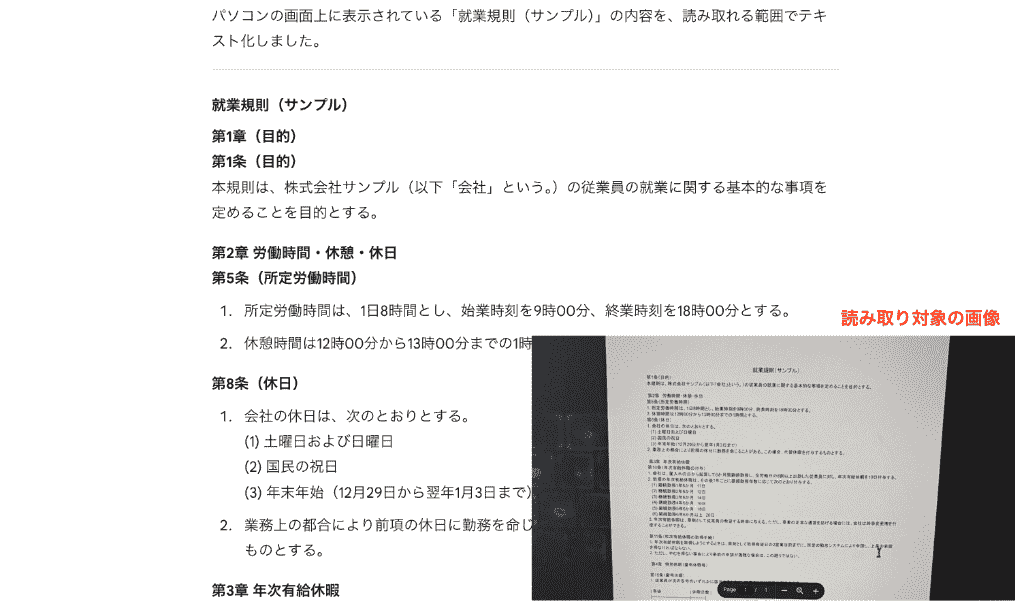

他にも、PC画面に表示されている書類画像を撮影したものをOCRしテキスト化してもらいましたが、こちらの結果も問題ありませんでした!

人の目では文字を読み取れないほどの小ささだったのですが、しっかりと内容を読み取っています。

若干内容が重複しているところも見られましたが、許容範囲内ということにしておきましょう!

これだけの読み取り精度であれば、人の手による最終チェックを行うことを忘れなければ、レシートの読み取りや契約書の細かい条項チェックなど、十分に実用に値すると評価できますね。

3.不鮮明な画像の推論

最後の検証では、あえて照明が暗い場所で撮影した写真をアップロードし、「ここはどこで、何が写っているか」を質問してみました。

人の目でもかなり目をこらさないと何が置いてあるのかがわからないような写真ですが、Geminiはどのように画像を認識するでしょうか?

入力プロンプト

この画像はどういった場所を写したものですか?分かる範囲で説明してください。

画像自体は不鮮明でしたが、Geminiは「キッチンのシンク周りを写したもの」と判断し、画像の中から確認できる範囲の物体の特徴を挙げてくれました!

推論ベースでもかなり高い精度で場所を特定できており、色の判別もほぼ正確です。

【シンク傍のワイヤーバスケット】を特定しているのはすごいなと感じました。

この画像認識能力を活かせれば、ブレのある写真データやトーンが暗く内容がわかりにくい画像データでもスムーズに情報確認をこなせるようになるでしょう!

💵APIの価格と利用方法

開発者や企業がシステムにGeminiを組み込む場合、APIを利用します。

特筆すべきは、その圧倒的なコストパフォーマンスです!

一例となりますが、軽量モデルを利用する場合、画像入力にかかるコストは100万トークン(画像数千枚分に相当)の入力で約11円〜45円(※執筆時のレート換算)と、非常に安価に設定。

これは、大量の画像を処理する必要があるECサイトの商品管理や工場の検品システムなどにとって大きなメリットとなります!

また、開発者向けのプラットフォーム(Google AI Studioなど)では、一定の利用量まで無料で使える枠が提供されていることが多く、コストをかけずに最新の画像認識機能をテスト導入することが可能です。

👥競合モデルとの比較

画像認識に対応したAIモデルは他にも存在しますが、Geminiには独自のアドバンテージがあります。

ChatGPTとの比較

ChatGPTも非常に高い認識能力を持っていますが、Geminiの強みは「動的な再確認」のプロセスにあるのです。

特に、数え上げや座標特定といったタスクでは、自律的に確認を行うGeminiの方が正確な結果を出しやすい傾向にあります。

Claudeとの比較

Claudeは長文の文脈理解に優れていますが、画像認識において、Geminiは複数の形式(モダリティ)を同時に理解・生成できるように設計されているんです。

動画の認識や画像と音声を組み合わせた解析など、複数のデータ形式を扱うタスクではGeminiが一歩リードしています!

🖌️まとめ

今回Geminiの画像認識力を検証してきましたが、複雑な状況下での特定能力と推論力には驚きを隠せません!

高難度探索では一部で誤認は見られたものの、暗所画像の検証では、場所を特定・推論する高度な認識能力を見せつけました。

実務に直結するOCR検証でもその精度は極めて高いレベルにあり、整理する処理能力はもはや実用段階に達しているといっても過言ではないでしょう!

一部の誤認識や重複は残るため、人の手による最終チェックは欠かせませんが、レシート管理から不鮮明な証拠写真の解析まで、Geminiはビジネスの現場で「視覚情報のデジタル化」を劇的に加速させる強力なツールとなるはずです。

🌲Yoomでできること

Geminiの画像認識機能は、Yoomを使って業務フローに組み込むことで、真の価値を発揮できるはず!

「画像をフォルダに入れたら自動で解析」「メールで届いた書類を自動でタスク化」といった仕組みを作れば、日々の単純作業から解放されるでしょう。

Yoomは、Geminiと連携するためのテンプレートを多数ご用意。

まずは以下のテンプレートから、自動化を体験してみてください!

Google Driveに格納されたファイルをOCRで読み取り、Geminiで要約してGoogle スプレッドシートに追加する

試してみる

■概要

このワークフローでは、Google Driveに保存されたファイルをgemini OCRでテキスト化し、Geminiで要約します。そして、その結果を自動的にGoogle スプレッドシートに追加することが可能です。これにより、書類のデジタル化とデータ整理がスムーズに行え、日常業務の効率化が図れます。

Yoomを利用すると、プログラミング不要で簡単にアプリ同士を連携することができます。

■このテンプレートをおすすめする方

- Google Driveで多くのファイルを管理しているビジネスユーザー

- 書類や画像データのテキスト化を自動化したい事務担当者

- 手動でのデータ入力作業を削減したいチームリーダー

- Geminiを活用して業務プロセスを改善したいIT担当者

- データ整理やレポート作成の効率化を目指す企業の経営者

■このテンプレートを使うメリット

- 手動入力の手間を省き、業務効率を向上

- Geminiにより高精度なテキスト化が可能

- 要約機能で情報整理が簡単に

- データの一元管理で作業ミスを防止

Google Driveでファイルが更新されたら、更新ファイルをGeminiで読み取る

試してみる

■概要

Google Driveに保存された報告書や議事録などのドキュメントを、更新のたびに手動で開いて内容を確認する作業は手間がかかるものです。また、重要な更新を見落としてしまうリスクも伴います。このワークフローを活用すれば、Google Driveの特定ファイルが更新されると、その内容をGeminiが自動で読み取り、要約などの処理を実行できます。定型的な情報収集作業から解放され、より重要な業務に集中することが可能になります。

■このテンプレートをおすすめする方

- Google Drive上のドキュメントを定期的に確認しており、作業を効率化したい方

- Geminiを活用し、ドキュメントの要約やテキスト抽出を自動化したいと考えている方

- ファイル更新の見落としを防ぎ、チーム内での迅速な情報共有を実現したいマネージャーの方

■このテンプレートを使うメリット

- ファイルが更新されるとGeminiが自動で内容を処理するため、手動でファイルを開いて確認する時間を短縮し、情報収集を効率化します。

- 手動での確認作業が不要になることで、重要な更新情報の見落としや確認漏れといったヒューマンエラーを防ぎ、業務の確実性が向上します。

■フローボットの流れ

- はじめに、Google DriveとGeminiをYoomと連携します。

- 次に、トリガーでGoogle Driveを選択し、「特定のファイルが作成または更新されたら」というアクションを設定します。

- 続いて、オペレーションで分岐機能を設定し、特定の条件に合致した場合のみ後続の処理が実行されるようにします。

- 次に、オペレーションでGoogle Driveの「ファイルをダウンロードする」アクションを設定します。

- 続いて、オペレーションでGeminiの「ファイルをアップロード」アクションを設定し、ダウンロードしたファイルを指定します。

- 次に、オペレーションでGeminiの「コンテンツを生成」アクションを設定し、アップロードしたファイルの内容を要約するよう指示します。

- 最後に、オペレーションでMicrosoft Teamsの「チャネルにメッセージを送る」を設定し、生成された要約を指定のチャネルに通知します。

※「トリガー」:フロー起動のきっかけとなるアクション、「オペレーション」:トリガー起動後、フロー内で処理を行うアクション

■このワークフローのカスタムポイント

- Google Driveのトリガー設定では、監視対象としたいフォルダのIDやファイル名を指定できます。また、フローが起動する間隔も任意で設定可能です。

- 分岐機能では、トリガーで取得した情報をもとに、特定のファイル名や拡張子の場合のみ後続の処理を実行するなど、条件を自由にカスタマイズできます。

- Google Driveの「ファイルをダウンロードする」では、トリガーで取得したアウトプット情報を活用して、対象のファイルIDを指定します。

- Geminiの「ファイルをアップロード」では、ファイルの添付方法を指定し、前段のオペレーションでダウンロードしたファイルを指定します。

- Geminiの「コンテンツを生成」では、利用するモデルや、ファイル内容の要約、翻訳、分析など、実行させたい内容をプロンプトで自由に設定できます。

- Microsoft Teamsの「チャネルにメッセージを送る」では、通知先のチームIDやチャネルID、Geminiが生成した内容を含んだメッセージ本文を任意で設定してください。

■注意事項

- Google Drive、Gemini、Microsoft TeamsとYoomを連携してください。

- 分岐はミニプラン以上のプランでご利用いただける機能(オペレーション)となっております。フリープランの場合は設定しているフローボットのオペレーションはエラーとなりますので、ご注意ください。

- ミニプランなどの有料プランは、2週間の無料トライアルを行うことが可能です。無料トライアル中には制限対象のアプリや機能(オペレーション)を使用することができます。。

- ダウンロード可能なファイル容量は最大300MBまでです。アプリの仕様によっては300MB未満になる可能性があるので、ご注意ください。

- トリガー、各オペレーションでの取り扱い可能なファイル容量の詳細はこちら

- トリガーは5分、10分、15分、30分、60分の間隔で起動間隔を選択できます。

- プランによって最短の起動間隔が異なりますので、ご注意ください。

- Microsoft365(旧Office365)には、家庭向けプランと一般法人向けプラン(Microsoft365 Business)があり、一般法人向けプランに加入していない場合には認証に失敗する可能性があります。

メールの内容をGeminiで解析し、特定種別のタスクをTodoistに作成する

試してみる

■概要

日々のメール対応に追われ、重要な依頼をタスク管理ツールへ転記する作業に手間を感じていませんか。このワークフローは、Gmailで受信したメールの内容をGeminiが自動で解析し、Todoistへタスクとして登録します。GeminiとTodoistを連携させることで、メールからのタスク作成を自動化し、対応漏れや手作業による入力の手間といった課題をスムーズに解消します。

■このテンプレートをおすすめする方

- メールで受けた依頼をTodoistで管理しており、登録作業に手間を感じている方

- GeminiとTodoistを連携させ、タスク管理の自動化を実現したいと考えている方

- 手作業によるタスクの転記ミスや、重要な依頼の対応漏れを防ぎたい方

■このテンプレートを使うメリット

- メールの内容をGeminiが解析し、Todoistへ自動でタスク作成するため、これまで手作業で行っていたタスク登録の時間を短縮することができます。

- 手作業での転記による入力ミスや、重要な依頼の見落としといったヒューマンエラーを防ぎ、タスクの対応漏れのリスクを軽減します。

■フローボットの流れ

- はじめに、Gmail、Gemini、TodoistをYoomと連携します。

- 次に、トリガーでGmailを選択し、「特定のキーワードに一致するメールを受信したら」というアクションを設定し、フローボットを起動する条件を指定します。

- 次に、オペレーションでGeminiの「コンテンツを生成」アクションを設定し、受信したメール本文の要約やタスク情報の抽出をさせます。

- 次に、AI機能の「テキストからデータを抽出する」を使用し、Geminiが生成したテキストから、タスク名や期限などの必要な情報を抽出します。

- 次に、分岐機能を設定し、抽出した情報をもとに後続の処理を行うかどうかの条件を指定します。

- 最後に、オペレーションでTodoistの「タスクを作成」アクションを設定し、抽出した情報をもとにタスクを自動で作成します。

※「トリガー」:フロー起動のきっかけとなるアクション、「オペレーション」:トリガー起動後、フロー内で処理を行うアクション

■このワークフローのカスタムポイント

- Gmailのトリガー設定では、「依頼」や「至急」など、検知したいメールに含まれるキーワードを任意で設定してください。

- Geminiに設定するプロンプト(指示文)は自由に編集可能です。メール本文からどのような情報を抽出し、どういった形式で出力させたいかを指定してください。

- AI機能によるデータ抽出では、タスク名や期限など、Todoistに登録したい項目を任意で設定できます。

- 分岐機能では、抽出した情報に含まれる特定のキーワードを条件に、後続の処理を分岐させることが可能です。

- Todoistへのタスク登録では、抽出した情報をタスク名や期限に設定したり、特定のプロジェクトやラベルを割り当てるようカスタムできます。

■注意事項

- Gmail、Gemini、TodoistのそれぞれとYoomを連携してください。

- トリガーは5分、10分、15分、30分、60分の間隔で起動間隔を選択できます。

- プランによって最短の起動間隔が異なりますので、ご注意ください。

- 分岐はミニプラン以上のプランでご利用いただける機能(オペレーション)となっております。フリープランの場合は設定しているフローボットのオペレーションはエラーとなりますので、ご注意ください。

- ミニプランなどの有料プランは、2週間の無料トライアルを行うことが可能です。無料トライアル中には制限対象のアプリや機能(オペレーション)を使用することができます。

■概要

このワークフローでは、Google Driveに保存されたファイルをgemini OCRでテキスト化し、Geminiで要約します。そして、その結果を自動的にGoogle スプレッドシートに追加することが可能です。これにより、書類のデジタル化とデータ整理がスムーズに行え、日常業務の効率化が図れます。

Yoomを利用すると、プログラミング不要で簡単にアプリ同士を連携することができます。

■このテンプレートをおすすめする方

- Google Driveで多くのファイルを管理しているビジネスユーザー

- 書類や画像データのテキスト化を自動化したい事務担当者

- 手動でのデータ入力作業を削減したいチームリーダー

- Geminiを活用して業務プロセスを改善したいIT担当者

- データ整理やレポート作成の効率化を目指す企業の経営者

■このテンプレートを使うメリット

- 手動入力の手間を省き、業務効率を向上

- Geminiにより高精度なテキスト化が可能

- 要約機能で情報整理が簡単に

- データの一元管理で作業ミスを防止

■概要

Google Driveに保存された報告書や議事録などのドキュメントを、更新のたびに手動で開いて内容を確認する作業は手間がかかるものです。また、重要な更新を見落としてしまうリスクも伴います。このワークフローを活用すれば、Google Driveの特定ファイルが更新されると、その内容をGeminiが自動で読み取り、要約などの処理を実行できます。定型的な情報収集作業から解放され、より重要な業務に集中することが可能になります。

■このテンプレートをおすすめする方

- Google Drive上のドキュメントを定期的に確認しており、作業を効率化したい方

- Geminiを活用し、ドキュメントの要約やテキスト抽出を自動化したいと考えている方

- ファイル更新の見落としを防ぎ、チーム内での迅速な情報共有を実現したいマネージャーの方

■このテンプレートを使うメリット

- ファイルが更新されるとGeminiが自動で内容を処理するため、手動でファイルを開いて確認する時間を短縮し、情報収集を効率化します。

- 手動での確認作業が不要になることで、重要な更新情報の見落としや確認漏れといったヒューマンエラーを防ぎ、業務の確実性が向上します。

■フローボットの流れ

- はじめに、Google DriveとGeminiをYoomと連携します。

- 次に、トリガーでGoogle Driveを選択し、「特定のファイルが作成または更新されたら」というアクションを設定します。

- 続いて、オペレーションで分岐機能を設定し、特定の条件に合致した場合のみ後続の処理が実行されるようにします。

- 次に、オペレーションでGoogle Driveの「ファイルをダウンロードする」アクションを設定します。

- 続いて、オペレーションでGeminiの「ファイルをアップロード」アクションを設定し、ダウンロードしたファイルを指定します。

- 次に、オペレーションでGeminiの「コンテンツを生成」アクションを設定し、アップロードしたファイルの内容を要約するよう指示します。

- 最後に、オペレーションでMicrosoft Teamsの「チャネルにメッセージを送る」を設定し、生成された要約を指定のチャネルに通知します。

※「トリガー」:フロー起動のきっかけとなるアクション、「オペレーション」:トリガー起動後、フロー内で処理を行うアクション

■このワークフローのカスタムポイント

- Google Driveのトリガー設定では、監視対象としたいフォルダのIDやファイル名を指定できます。また、フローが起動する間隔も任意で設定可能です。

- 分岐機能では、トリガーで取得した情報をもとに、特定のファイル名や拡張子の場合のみ後続の処理を実行するなど、条件を自由にカスタマイズできます。

- Google Driveの「ファイルをダウンロードする」では、トリガーで取得したアウトプット情報を活用して、対象のファイルIDを指定します。

- Geminiの「ファイルをアップロード」では、ファイルの添付方法を指定し、前段のオペレーションでダウンロードしたファイルを指定します。

- Geminiの「コンテンツを生成」では、利用するモデルや、ファイル内容の要約、翻訳、分析など、実行させたい内容をプロンプトで自由に設定できます。

- Microsoft Teamsの「チャネルにメッセージを送る」では、通知先のチームIDやチャネルID、Geminiが生成した内容を含んだメッセージ本文を任意で設定してください。

■注意事項

- Google Drive、Gemini、Microsoft TeamsとYoomを連携してください。

- 分岐はミニプラン以上のプランでご利用いただける機能(オペレーション)となっております。フリープランの場合は設定しているフローボットのオペレーションはエラーとなりますので、ご注意ください。

- ミニプランなどの有料プランは、2週間の無料トライアルを行うことが可能です。無料トライアル中には制限対象のアプリや機能(オペレーション)を使用することができます。。

- ダウンロード可能なファイル容量は最大300MBまでです。アプリの仕様によっては300MB未満になる可能性があるので、ご注意ください。

- トリガー、各オペレーションでの取り扱い可能なファイル容量の詳細はこちら

- トリガーは5分、10分、15分、30分、60分の間隔で起動間隔を選択できます。

- プランによって最短の起動間隔が異なりますので、ご注意ください。

- Microsoft365(旧Office365)には、家庭向けプランと一般法人向けプラン(Microsoft365 Business)があり、一般法人向けプランに加入していない場合には認証に失敗する可能性があります。

■概要

日々のメール対応に追われ、重要な依頼をタスク管理ツールへ転記する作業に手間を感じていませんか。このワークフローは、Gmailで受信したメールの内容をGeminiが自動で解析し、Todoistへタスクとして登録します。GeminiとTodoistを連携させることで、メールからのタスク作成を自動化し、対応漏れや手作業による入力の手間といった課題をスムーズに解消します。

■このテンプレートをおすすめする方

- メールで受けた依頼をTodoistで管理しており、登録作業に手間を感じている方

- GeminiとTodoistを連携させ、タスク管理の自動化を実現したいと考えている方

- 手作業によるタスクの転記ミスや、重要な依頼の対応漏れを防ぎたい方

■このテンプレートを使うメリット

- メールの内容をGeminiが解析し、Todoistへ自動でタスク作成するため、これまで手作業で行っていたタスク登録の時間を短縮することができます。

- 手作業での転記による入力ミスや、重要な依頼の見落としといったヒューマンエラーを防ぎ、タスクの対応漏れのリスクを軽減します。

■フローボットの流れ

- はじめに、Gmail、Gemini、TodoistをYoomと連携します。

- 次に、トリガーでGmailを選択し、「特定のキーワードに一致するメールを受信したら」というアクションを設定し、フローボットを起動する条件を指定します。

- 次に、オペレーションでGeminiの「コンテンツを生成」アクションを設定し、受信したメール本文の要約やタスク情報の抽出をさせます。

- 次に、AI機能の「テキストからデータを抽出する」を使用し、Geminiが生成したテキストから、タスク名や期限などの必要な情報を抽出します。

- 次に、分岐機能を設定し、抽出した情報をもとに後続の処理を行うかどうかの条件を指定します。

- 最後に、オペレーションでTodoistの「タスクを作成」アクションを設定し、抽出した情報をもとにタスクを自動で作成します。

※「トリガー」:フロー起動のきっかけとなるアクション、「オペレーション」:トリガー起動後、フロー内で処理を行うアクション

■このワークフローのカスタムポイント

- Gmailのトリガー設定では、「依頼」や「至急」など、検知したいメールに含まれるキーワードを任意で設定してください。

- Geminiに設定するプロンプト(指示文)は自由に編集可能です。メール本文からどのような情報を抽出し、どういった形式で出力させたいかを指定してください。

- AI機能によるデータ抽出では、タスク名や期限など、Todoistに登録したい項目を任意で設定できます。

- 分岐機能では、抽出した情報に含まれる特定のキーワードを条件に、後続の処理を分岐させることが可能です。

- Todoistへのタスク登録では、抽出した情報をタスク名や期限に設定したり、特定のプロジェクトやラベルを割り当てるようカスタムできます。

■注意事項

- Gmail、Gemini、TodoistのそれぞれとYoomを連携してください。

- トリガーは5分、10分、15分、30分、60分の間隔で起動間隔を選択できます。

- プランによって最短の起動間隔が異なりますので、ご注意ください。

- 分岐はミニプラン以上のプランでご利用いただける機能(オペレーション)となっております。フリープランの場合は設定しているフローボットのオペレーションはエラーとなりますので、ご注意ください。

- ミニプランなどの有料プランは、2週間の無料トライアルを行うことが可能です。無料トライアル中には制限対象のアプリや機能(オペレーション)を使用することができます。

[Yoomとは]

プログラミング知識なしで手軽に構築できます。