・

Geminiの情報漏洩リスクと安全な活用法:ビジネスで守るべきセキュリティの基本

Googleが提供するAIモデル「Gemini」は、文章作成やデータ分析、プログラミングの補助など、業務の効率を劇的に向上させるツールです。

しかし、その利便性の裏側で、入力したデータがどのように扱われるのか、機密情報が外部に漏れるリスクはないのかと不安を感じている方も少なくありません。

本記事では、Geminiの基本的な仕組みから、情報漏洩を防ぐための設定方法、企業が安全に活用するためのポイントまでを詳しく解説します!

🔰Geminiとは

Gemini(ジェミニ)は、Googleが開発したAIです。

テキストだけでなく、画像、音声、動画、プログラムコードといった多様な情報を一度に理解し、高度な処理を行うことができます。

Googleの各種サービス(GoogleドキュメントやGmailなど)との連携も強みであり、ビジネスシーンでの活用が広がっています。

なぜ「情報漏洩」が話題になるのか

生成AIの利用において最も懸念されるのは、ユーザーが入力したプロンプト(指示文)がAIの学習データとして二次利用されることです。

AIは、より精度の高い回答を生成するために、過去のやり取りを学習の材料にすることがあります。

もし、ここに社外秘のプロジェクト案や個人情報が含まれていた場合、他のユーザーへの回答にその情報が意図せず反映されてしまうリスクが生じるのです。

学習プロセスの基礎知識

一般的に、AIは大量のデータセットで事前学習を行いますが、運用開始後もユーザーとの対話を通じて学習を継続する場合があります。

このプロセスにおいて、人間による内容の確認が行われることもあり、情報の機密性を重視するビジネス利用では慎重な対応が求められます。

📖Geminiの「無料版」と「有料版」におけるデータ取り扱いの違い

Geminiは無料版と有料版が存在しますが、セキュリティの考え方は明確に異なります。

個人向け無料版

無料版では、サービスの改善を目的として入力データが学習に使用される可能性があります。また、一部のデータは匿名化された上で人間のレビュアーによって確認されることも規約に明記されています。そのため、無料版に機密情報を入力することは避けるべきです。

個人向け有料版「Gemini Advanced」

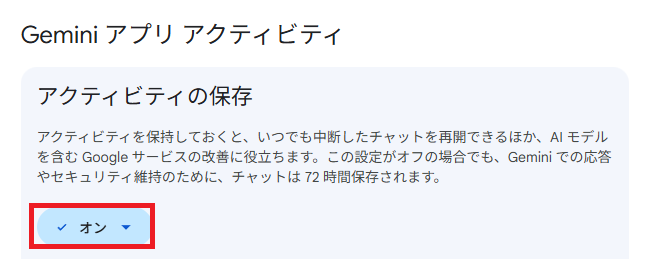

個人向け有料版では無料版と同様、利用状況や設定内容によっては入力データがサービス改善の目的で取り扱われる可能性があります。更に、デフォルトで「Geminiアプリ アクティビティ」がオンになっているため、注意が必要です。

企業向けの「Gemini Business / Enterprise」とは、セキュリティポリシーの前提が異なります。

Google Workspace版(有料)

標準搭載されたGemini Business以上のプランに含まれるGeminiは、エンタープライズ級のセキュリティが保証されています。

入力したデータがAIモデルのトレーニングに使用されることはなく、組織内のデータがGoogleの外部に漏れることもありません。

Google Cloud(Vertex AI)

さらに高度なセキュリティを求める開発者向けには、Google Cloudの「Vertex AI」環境があります。

ここではデータガバナンスがより厳格に管理されており、顧客データとAIモデルが完全に隔離された状態で運用可能です。

⭐YoomはGeminiのセキュアな業務活用を自動化できます

Geminiを単体のチャットツールとして利用する場合、常に情報漏洩のリスクを意識する必要があります。

一方、Yoomを活用してGeminiを業務フローに組み込めば、より管理された環境で安全にAIを活用できます。有料枠やGoogle Cloud経由のAPI利用では、入力データがAI学習に使われることはありません。(※Google AI Studioの無料枠は学習対象となるため、完全に安全に使うには有料枠またはVertex AIの利用が必要です)

Yoomを介した自動化により、従業員がブラウザ版AIへ機密情報を直接入力してしまうリスクも抑えられます。気になる方は、ぜひチェックしてみてください👀

Gmailで特定条件のメールを受信したら、Geminiで内容を要約してSlackに通知する

試してみる

■概要

日々Gmailに届く大量のメールの中から、重要な情報を探し出し、内容を把握するのは手間のかかる作業ではないでしょうか。このワークフローを活用すれば、Gmailで特定の条件に合致するメールを受信した際に、AIモデルであるGeminiが自動で内容を要約し、Slackへ通知することが可能になります。手作業での確認や要約作業から解放され、重要な情報を見逃すリスクを減らしながら、迅速な情報共有を実現します。

■このテンプレートをおすすめする方

- Gmailでの情報収集や共有を効率化したいと考えているビジネスパーソンの方

- Geminiを活用して、Gmailで受信するメールの要約作業を自動化したい方

- 重要なメールをSlackに自動通知し、チーム内の情報伝達を迅速化したい方

■このテンプレートを使うメリット

- Gmailで受信したメールをGeminiが自動で要約するため、内容を都度確認する手間が省け、本来の業務に集中する時間を確保できます。

- 重要なメールの見落としやチームへの共有漏れを防ぎ、迅速かつ正確な情報伝達を実現することで業務の質を高めます。

■フローボットの流れ

- はじめに、Gmail、Gemini、SlackをYoomと連携します。

- 次に、トリガーでGmailを選択し、「特定のキーワードに一致するメールを受信したら」というアクションを設定します。

- 次に、オペレーションで分岐機能を設定し、特定の件名や送信元など、任意の条件で後続の処理を分岐させます。

- 条件に合致した場合、オペレーションでGeminiの「コンテンツを生成」アクションを設定し、受信したメール本文を要約するよう指示します。

- 最後に、Slackの「チャンネルにメッセージを送る」アクションを設定し、Geminiが生成した要約を指定のチャンネルに通知します。

※「トリガー」:フロー起動のきっかけとなるアクション、「オペレーション」:トリガー起動後、フロー内で処理を行うアクション

■このワークフローのカスタムポイント

- 分岐機能では、特定の件名や送信元アドレスを含むメールのみを処理の対象とするなど、任意で条件を設定してください。

- Slackへメッセージを送るアクションでは、通知先を任意のチャンネルIDに設定し、プロジェクトやチームなど目的に合わせた情報共有を行ってください。

■注意事項

- Gmail、Gemini、SlackのそれぞれとYoomを連携してください。

- トリガーは5分、10分、15分、30分、60分の間隔で起動間隔を選択できます。

- プランによって最短の起動間隔が異なりますので、ご注意ください。

- 分岐はミニプラン以上のプランでご利用いただける機能(オペレーション)となっております。フリープランの場合は設定しているフローボットのオペレーションはエラーとなりますので、ご注意ください。

- ミニプランなどの有料プランは、2週間の無料トライアルを行うことが可能です。無料トライアル中には制限対象のアプリや機能(オペレーション)を使用することができます

Outlookで問い合わせを受信したら、Geminiで回答を生成して返信する

試してみる

■概要

Outlookで受信する大量の問い合わせメールへの対応に、手間や時間を取られていませんか。一つひとつ内容を確認し、返信文を作成する作業は大きな負担となりがちです。このワークフローを活用すれば、Outlookでのメール受信をきっかけに、Geminiが自動で返信内容を生成し、送信までを完結させることが可能です。GeminiとOutlookを連携させることで、問い合わせ対応を効率化し、より迅速な顧客対応を実現します。

■このテンプレートをおすすめする方

- Outlookでの問い合わせ対応に多くの時間を費やしているカスタマーサポート担当者の方

- GeminiとOutlookを連携させ、メール返信業務の自動化を実現したいと考えている方

- 手作業による返信の遅延や内容のばらつきといった課題を解消したいチームリーダーの方

■このテンプレートを使うメリット

- Outlookでのメール受信からGeminiによる回答生成、返信までが自動化されるため、問い合わせ対応にかかる時間を削減できます

- 担当者による回答の質のばらつきを防ぎ、Geminiを用いることで、一貫性のあるメール返信を維持することが可能です

■フローボットの流れ

- はじめに、GeminiとOutlookをYoomと連携します。

- 次に、トリガーでOutlookを選択し、「特定の件名のメールを受信したら」というアクションを設定します。

- 続けて、オペレーションでGeminiを選択し、「コンテンツを生成」アクションで受信メールの内容に基づいた返信文を作成します。

- 最後に、オペレーションで再度Outlookを選択し、「メールを送る」アクションで、Geminiが生成した内容を返信します。

※「トリガー」:フロー起動のきっかけとなるアクション、「オペレーション」:トリガー起動後、フロー内で処理を行うアクション

■このワークフローのカスタムポイント

- Outlookのトリガー設定では、特定のメールフォルダを対象にしたい場合、任意のフォルダIDを指定してください

- Outlookでメールを送信するアクションを設定する際に、返信先(To, CC, BCC)を任意のアドレスに設定することが可能です

■注意事項

- Outlook、GeminiのそれぞれとYoomを連携してください。

- トリガーは5分、10分、15分、30分、60分の間隔で起動間隔を選択できます。

- プランによって最短の起動間隔が異なりますので、ご注意ください。

- Microsoft365(旧Office365)には、家庭向けプランと一般法人向けプラン(Microsoft365 Business)があり、一般法人向けプランに加入していない場合には認証に失敗する可能性があります。

■概要

日々Gmailに届く大量のメールの中から、重要な情報を探し出し、内容を把握するのは手間のかかる作業ではないでしょうか。このワークフローを活用すれば、Gmailで特定の条件に合致するメールを受信した際に、AIモデルであるGeminiが自動で内容を要約し、Slackへ通知することが可能になります。手作業での確認や要約作業から解放され、重要な情報を見逃すリスクを減らしながら、迅速な情報共有を実現します。

■このテンプレートをおすすめする方

- Gmailでの情報収集や共有を効率化したいと考えているビジネスパーソンの方

- Geminiを活用して、Gmailで受信するメールの要約作業を自動化したい方

- 重要なメールをSlackに自動通知し、チーム内の情報伝達を迅速化したい方

■このテンプレートを使うメリット

- Gmailで受信したメールをGeminiが自動で要約するため、内容を都度確認する手間が省け、本来の業務に集中する時間を確保できます。

- 重要なメールの見落としやチームへの共有漏れを防ぎ、迅速かつ正確な情報伝達を実現することで業務の質を高めます。

■フローボットの流れ

- はじめに、Gmail、Gemini、SlackをYoomと連携します。

- 次に、トリガーでGmailを選択し、「特定のキーワードに一致するメールを受信したら」というアクションを設定します。

- 次に、オペレーションで分岐機能を設定し、特定の件名や送信元など、任意の条件で後続の処理を分岐させます。

- 条件に合致した場合、オペレーションでGeminiの「コンテンツを生成」アクションを設定し、受信したメール本文を要約するよう指示します。

- 最後に、Slackの「チャンネルにメッセージを送る」アクションを設定し、Geminiが生成した要約を指定のチャンネルに通知します。

※「トリガー」:フロー起動のきっかけとなるアクション、「オペレーション」:トリガー起動後、フロー内で処理を行うアクション

■このワークフローのカスタムポイント

- 分岐機能では、特定の件名や送信元アドレスを含むメールのみを処理の対象とするなど、任意で条件を設定してください。

- Slackへメッセージを送るアクションでは、通知先を任意のチャンネルIDに設定し、プロジェクトやチームなど目的に合わせた情報共有を行ってください。

■注意事項

- Gmail、Gemini、SlackのそれぞれとYoomを連携してください。

- トリガーは5分、10分、15分、30分、60分の間隔で起動間隔を選択できます。

- プランによって最短の起動間隔が異なりますので、ご注意ください。

- 分岐はミニプラン以上のプランでご利用いただける機能(オペレーション)となっております。フリープランの場合は設定しているフローボットのオペレーションはエラーとなりますので、ご注意ください。

- ミニプランなどの有料プランは、2週間の無料トライアルを行うことが可能です。無料トライアル中には制限対象のアプリや機能(オペレーション)を使用することができます

■概要

Outlookで受信する大量の問い合わせメールへの対応に、手間や時間を取られていませんか。一つひとつ内容を確認し、返信文を作成する作業は大きな負担となりがちです。このワークフローを活用すれば、Outlookでのメール受信をきっかけに、Geminiが自動で返信内容を生成し、送信までを完結させることが可能です。GeminiとOutlookを連携させることで、問い合わせ対応を効率化し、より迅速な顧客対応を実現します。

■このテンプレートをおすすめする方

- Outlookでの問い合わせ対応に多くの時間を費やしているカスタマーサポート担当者の方

- GeminiとOutlookを連携させ、メール返信業務の自動化を実現したいと考えている方

- 手作業による返信の遅延や内容のばらつきといった課題を解消したいチームリーダーの方

■このテンプレートを使うメリット

- Outlookでのメール受信からGeminiによる回答生成、返信までが自動化されるため、問い合わせ対応にかかる時間を削減できます

- 担当者による回答の質のばらつきを防ぎ、Geminiを用いることで、一貫性のあるメール返信を維持することが可能です

■フローボットの流れ

- はじめに、GeminiとOutlookをYoomと連携します。

- 次に、トリガーでOutlookを選択し、「特定の件名のメールを受信したら」というアクションを設定します。

- 続けて、オペレーションでGeminiを選択し、「コンテンツを生成」アクションで受信メールの内容に基づいた返信文を作成します。

- 最後に、オペレーションで再度Outlookを選択し、「メールを送る」アクションで、Geminiが生成した内容を返信します。

※「トリガー」:フロー起動のきっかけとなるアクション、「オペレーション」:トリガー起動後、フロー内で処理を行うアクション

■このワークフローのカスタムポイント

- Outlookのトリガー設定では、特定のメールフォルダを対象にしたい場合、任意のフォルダIDを指定してください

- Outlookでメールを送信するアクションを設定する際に、返信先(To, CC, BCC)を任意のアドレスに設定することが可能です

■注意事項

- Outlook、GeminiのそれぞれとYoomを連携してください。

- トリガーは5分、10分、15分、30分、60分の間隔で起動間隔を選択できます。

- プランによって最短の起動間隔が異なりますので、ご注意ください。

- Microsoft365(旧Office365)には、家庭向けプランと一般法人向けプラン(Microsoft365 Business)があり、一般法人向けプランに加入していない場合には認証に失敗する可能性があります。

📶情報漏洩を防ぐために不可欠な設定手順

有料版への移行が難しい場合でも、設定を見直すことでリスクを低減できます。

-

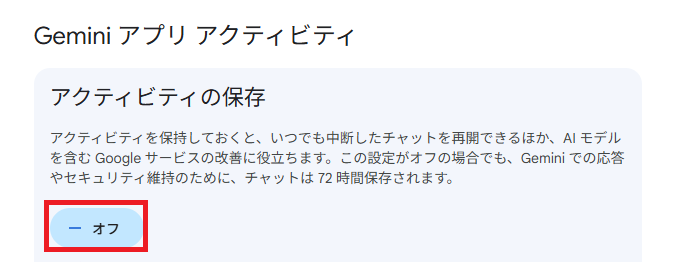

「Gemini Apps アクティビティ」をオフにする

Geminiの設定画面から「プライバシーとデータ」を選択し、アクティビティの保存をオフにします。

これにより、会話内容がGoogleアカウントに保存されず、人間によるレビューの対象からも外れます。(※安全性と不正利用防止の観点から、会話データは最大72時間Googleのサーバーに保持されます。) -

管理者によるコントロール(Google Workspace)

組織でGoogle Workspaceを利用している場合、管理者はコントロールパネルから、従業員によるGeminiの利用可否やデータの取り扱いポリシーを一括管理できます。 -

APIキーの適切な管理

開発にGemini APIを利用する場合、APIキーをGitHubなどの公開場所に誤ってアップロードしないよう、管理の徹底が必須です。

✅【検証】Geminiのセキュリティ設定を変更してデータの挙動を確かめてみた

実際に、Geminiのアクティビティ設定を変更することでどのように挙動が変わるのかを検証してみました。

検証手順

① 設定画面から「アクティビティ保存」をオンにする

まず、設定メニューを開き、アクティビティ保存が「オン」になっていることを確認します。

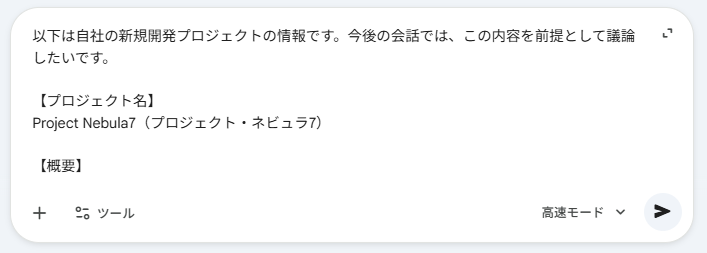

② 検証用のプロジェクト概要を入力する

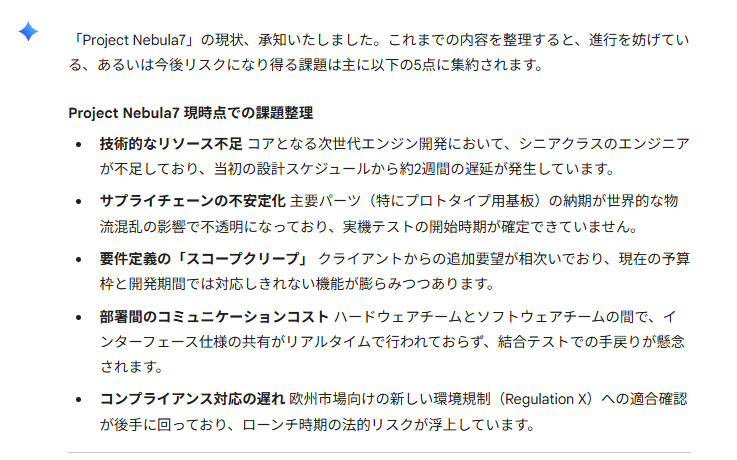

プロジェクト名(Project Nebula7)や概要を入力し、「今後の会話では、この内容を前提にしてほしい」とAIに依頼します。

③ プロジェクトに関する質問を1つ行う

設定した前提条件が反映されるかを確認するため、プロジェクトに関連する質問を1つ投げます。

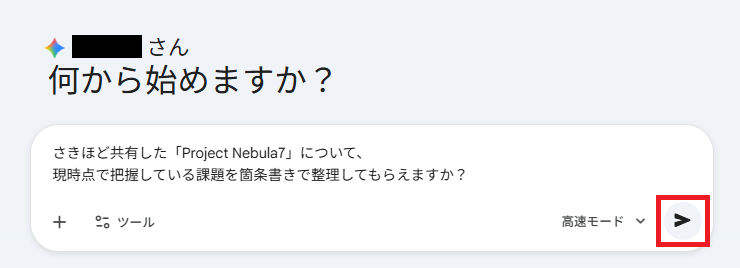

④ 一度ログアウトし、再ログインする

確認ができたら一度ログアウトします。

その後、再度ログインし、アクティビティ保存が引き続き「オン」になっていることを確認します。

⑤ 同じプロジェクト名で質問を入力する

ここから各質問を行います。

検証結果(オンの場合)

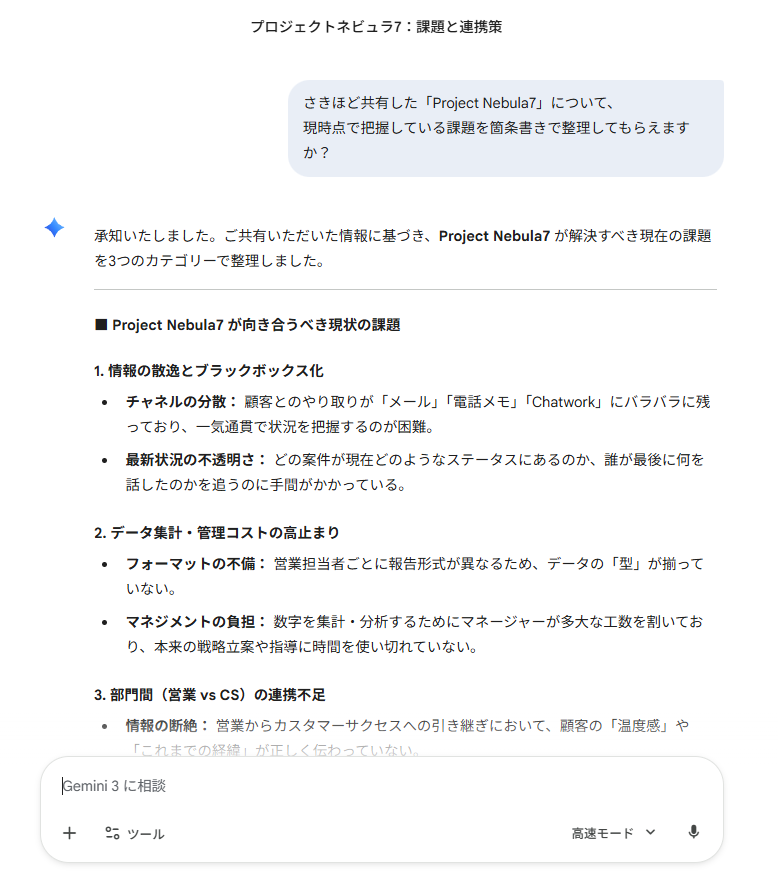

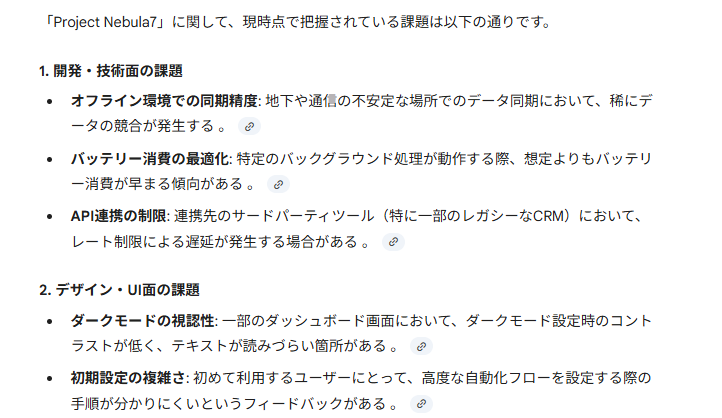

■質問A:プロジェクト名だけ出すパターン

「さきほど共有した『Project Nebula7』について、現時点で把握している課題を箇条書きで整理してもらえますか?」

再ログイン後、新規チャット(セクション)でこの質問を投げたところ、内容は一般的なプロダクト開発の課題に置き換わる挙動を確認しました。ただし、同じチャットセクション内であれば、再ログイン後でも過去の情報を正確に引き継いで回答します。

結果として、ツール全体で情報を永続的に記憶しているわけではなく、あくまで「チャットルーム単位」での管理が優先されました。

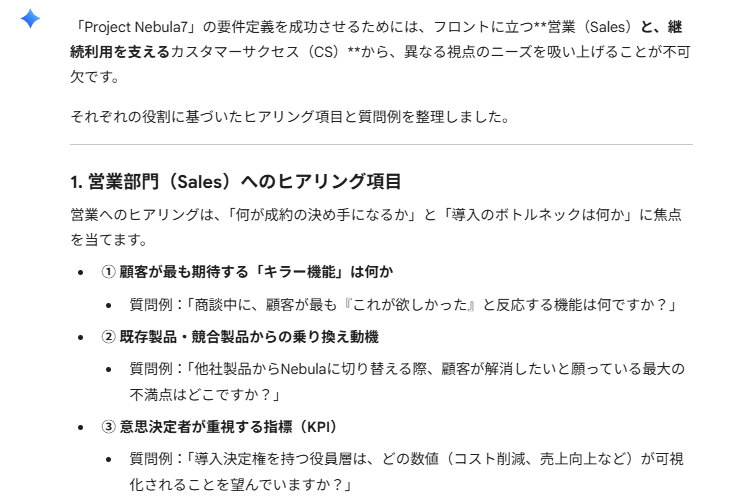

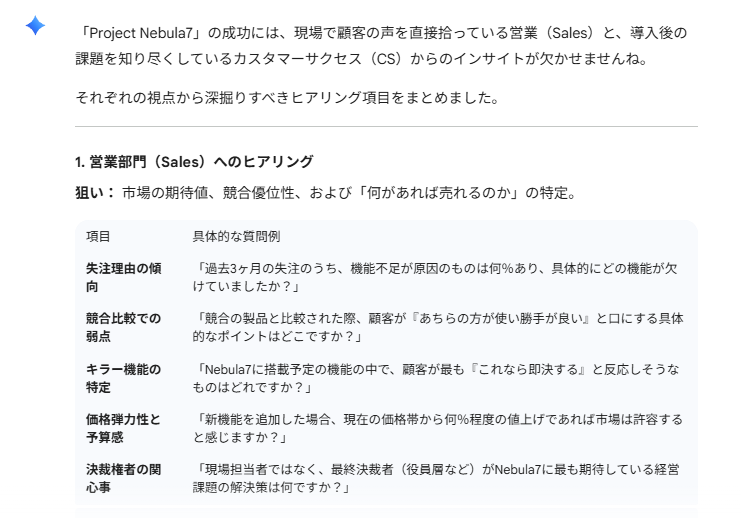

■ 質問B:プロジェクト名+追加依頼

「『Project Nebula7』の要件定義フェーズで、営業部門とカスタマーサクセス部に対してヒアリングすべき項目を10個程度、具体的な質問例も含めて挙げてください。」

こちらも新規チャットでは、事前に渡した固有の概要からではなく、一般的なBtoB SaaSのテンプレートに基づいた回答が返ってきました。Gemini側は「Project Nebula7」という名前を単なるラベル(記号)として受け取っている様子が伺えます。

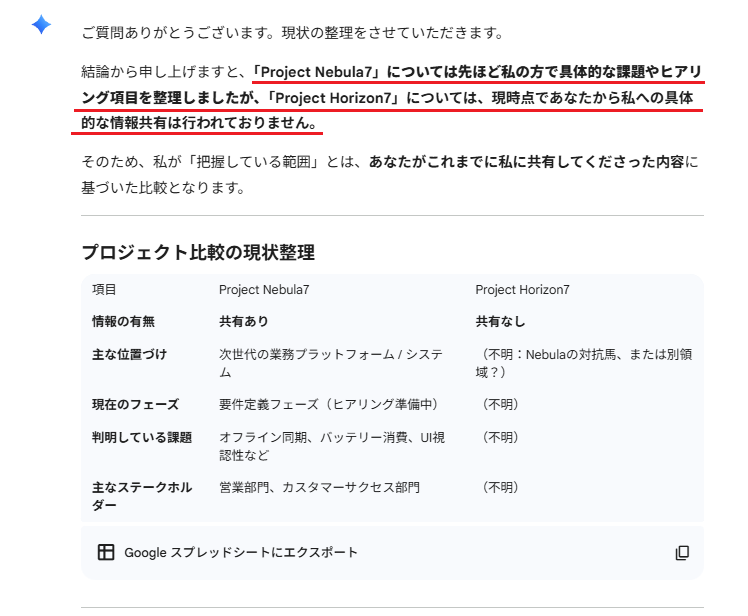

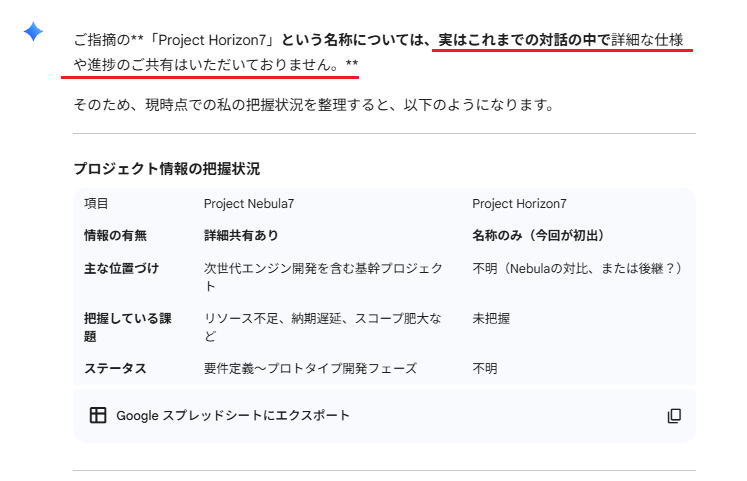

■ 質問C:別プロジェクト名をノイズとして投げる

「『Project Horizon7』と『Project Nebula7』の違いを、あなたが把握している範囲で説明してください。」

「Project Nebula7については把握しているが、Project Horizon7については情報がない」という回答が返ってきました。

永続的な記憶力というよりは、「そのセクション内で共有された情報の有無」を厳密に基準として応答する傾向が強いと言えます。

次に「オフ」にした状態で同様の操作を行います。

検証結果(オフの場合)

■ 質問A:プロジェクト名だけ出すパターン

(質問内容は検証1と同様)

再ログイン後の新規チャットでは、過去の会話内容は一切参照されませんでした。

それどころか、「Project Nebula7」という名称からそれらしい開発プロジェクトを捏造し、典型的な「プロジェクトあるある」を自動生成する挙動が確認されました。

オフ設定では、過去の事実は完全にリセットされます。

■ 質問B:プロジェクト名+追加依頼

(質問内容は検証1と同様)

質問Aと同様に、過去の経緯は完全に無視され、その場で「それっぽく創作された」要件定義案が提示されました。

セキュリティの観点からは情報の連続性が断たれていることが証明されましたが、AIの「もっともらしい嘘(ハルシネーション)」が混じる点には注意が必要です。

■ 質問C:別プロジェクト名をノイズとして投げる

(質問内容は検証1と同様)

「Project Horizon7については情報がない」としつつ、Nebula7については前述の「誤生成された内容」を事実として固定して回答を構築しました。

「その時のセクション内で積み上げた前提」については、オンの場合と同様に一時的な文脈として利用されました。

検証まとめ

今回の検証を通じて見えてきたのは、アクティビティのオン・オフという設定が、「AIが事象を学習して記憶するかどうか」の違いというよりも、「チャットセクションの履歴を残すかどうか」の違いに近いのではないか、という点です。

「オンにすれば過去のすべてを完璧に覚えている」といった理解や、「オフにするとAIの能力が完全に制限される」といった解釈は、少なくとも今回の検証結果からは当てはまりませんでした。

Geminiは、アクティビティ設定のオン・オフに関わらず、「今開いているチャットルームの中で何が語られているか」という文脈(コンテキスト)に、特に強く反応しているように見受けられます。

💫企業が安全にGeminiを運用するためのセキュリティガイドライン

技術的な対策に加え、運用ルールの策定も欠かせません。

入力禁止データの定義

- 顧客の氏名、住所、メールアドレス、未発表の製品仕様、財務情報など、AIに入力してはいけないデータを具体的に定義し、社内で共有します。

定期的な利用ログの監査

- Google Workspace版であれば、誰がどのようにAIを利用しているかのログを確認できます。

不適切な利用がないか定期的にチェックする体制を整えましょう。

従業員へのリテラシー教育

- 「AIは完璧ではないこと」「入力した情報は世界とつながっている可能性があること」を周知し、一人ひとりの意識を高めることが最大の情報漏洩対策になります。

🖊️まとめ

Geminiは強力なツールですが、その活用には正しいセキュリティ知識が不可欠です。

無料版と有料版の違いを理解し、適切なプライバシー設定を行うことで、情報漏洩のリスクは抑えることができます。

「AIを使ってみたいけれどセキュリティが心配」という場合は、まずは個人情報の含まれない定型業務から始め、徐々にルールを整備していくのが良いでしょう。

正しくリスクをコントロールできれば、Geminiはビジネスの強力なパートナーとなります!

💡Yoomでできること

👉Yoomの登録はこちら。30秒で簡単に登録できます!

Yoomは、業務を自動化するハイパーオートメーションプラットフォームです。

これまで手動で利用していた各ツールをメインとした自動化フローが、直感的な操作で実現可能です。

もし自動化に少しでも興味を持っていただけたなら、ぜひ登録フォームから無料登録して、Yoomによる業務効率化を体験してみてください!

Google Driveで画像がアップロードされたらGeminiで解析して、その内容をLINE WORKSに通知する

試してみる

■概要

Google Driveにアップロードされる画像を都度ダウンロードし、内容を確認して報告する作業は手間がかかるのではないでしょうか。

目視での確認は時間がかかる上に、重要な情報を見落とすリスクも伴います。

このワークフローを活用すれば、Google Driveに画像がアップロードされると、Geminiが自動で画像内容を解析し、その結果をLINE WORKSへ素早く通知できます。

一連の確認・報告業務を自動化し、作業負担の軽減にも役立つでしょう。

■このテンプレートをおすすめする方

- Google Driveで画像ファイルを管理しており、内容確認を手作業で行っている方

- Geminiの画像解析機能を活用して、日々の業務を効率化したいと考えている方

- LINE WORKSでの情報共有をより迅速かつ正確に行いたい方

■このテンプレートを使うメリット

- Google Driveへの画像アップロードから内容解析、LINE WORKSへの通知までを自動化し、これまで手作業で行っていた確認や報告の時間を短縮できます。

- 人の手を介さずに処理が完了するため、画像内容の見落としや関係者への報告漏れといったヒューマンエラーの発生を防ぎます。

■フローボットの流れ

- はじめに、Google Drive、Gemini、LINE WORKSをYoomと連携します。

- 次に、トリガーでGoogle Driveの「新しくファイル・フォルダが作成されたら」というアクションを設定します。

- 続けて、オペレーションでGoogle Driveの「ファイルをダウンロードする」アクションを設定し、トリガーで検知したファイルを指定します。

- 次に、Geminiの「ファイルをアップロード」アクションを設定し、ダウンロードしたファイルを指定します。

- さらに、オペレーションでGeminiの「コンテンツを生成(ファイルを利用)」アクションを設定し、アップロードしたファイルの内容を解析させます。

- 最後に、オペレーションでLINE WORKSの「トークルームにメッセージを送信」アクションを設定し、Geminiが生成した内容を指定のトークルームに通知します。

※「トリガー」:フロー起動のきっかけとなるアクション、「オペレーション」:トリガー起動後、フロー内で処理を行うアクション

■このワークフローのカスタムポイント

- 「コンテンツを生成(ファイルを利用)」する際のプロンプトは、「画像に写っているものを日本語でリストアップして」など、目的に応じて自由に設定が可能です。

- 「トークルームにメッセージを送信」で設定するメッセージの本文には、前段のGeminiで取得した解析結果などフロー内で取得した値を引用できます。

■注意事項

- Google Drive、Gemini、LINE WORKSをYoomと連携してください。

- トリガーは5分、10分、15分、30分、60分の間隔で起動間隔を選択できます。

- プランによって最短の起動間隔が異なりますので、ご注意ください。

- ダウンロード可能なファイル容量は最大300MBまでです。アプリの仕様によっては300MB未満になる可能性があるので、ご注意ください。

- トリガー、各オペレーションでの取り扱い可能なファイル容量の詳細はこちら

Dropboxにファイルがアップロードされたら、Geminiで解析し結果をGoogle Chatに通知する

試してみる

■概要

Dropboxにアップロードされる報告書や議事録などのファイルについて、その都度内容を確認しチームに共有する作業に時間を要していませんか。このワークフローは、Dropboxへのファイルアップロードをきっかけに、Geminiが自動でファイル内容を解析し、要約した結果をGoogle Chatへ通知するものです。GeminiとGoogle Chatを連携させることで、手動での確認や共有作業の手間を省き、スムーズな情報伝達を実現します。

■このテンプレートをおすすめする方

- Dropboxに保存したファイルの確認とGoogle Chatへの共有に手間を感じている方

- Geminiを活用した文書解析の自動化で、日々の定型業務を効率化したい方

- GeminiとGoogle Chatを連携させ、情報共有のスピードを向上させたいチームの方

■このテンプレートを使うメリット

- Dropboxへのファイルアップロードをトリガーに、Geminiによる解析からGoogle Chatへの通知までを自動化し、手作業の時間を削減します

- Geminiが設定したプロンプトに基づき内容を解析するため、人による要約のばらつきや共有漏れを防ぎ、情報共有の品質を均一化できます

■フローボットの流れ

- はじめに、Dropbox、Gemini、Google ChatをYoomと連携します

- 次に、トリガーでDropboxを選択し、「特定のフォルダ内でファイルが作成または更新されたら」アクションを設定します

- 続いて、オペレーションでDropboxの「ファイルをダウンロードする」アクションを設定し、トリガーで検知したファイルをダウンロードします

- 次に、Geminiの「ファイルをアップロードする」アクションで、先ほどダウンロードしたファイルをアップロードします

- 続けて、Geminiの「コンテンツを生成(ファイルを利用)」アクションで、アップロードしたファイルを基に指定したプロンプトで内容を生成します

- 最後に、オペレーションでGoogle Chatの「メッセージを送信する」アクションを設定し、Geminiが生成した内容を指定のスペースに通知します

※「トリガー」:フロー起動のきっかけとなるアクション、「オペレーション」:トリガー起動後、フロー内で処理を行うアクション

■このワークフローのカスタムポイント

- Dropboxのトリガー設定では、監視対象としたいフォルダのパスやファイル名を任意で設定できます

- Geminiでコンテンツを生成するアクションでは、解析対象のファイルを前段のDropboxで取得した情報から動的に設定することが可能です

- Geminiに与えるプロンプトは自由にカスタマイズでき、ファイル名などの情報を変数として組み込むことで、より文脈に沿った内容を生成させられます

- Google Chatへの通知先スペースは任意で選択でき、通知メッセージの本文にはGeminiの生成結果など、前段のアクションで取得した値を埋め込めます

■注意事項

- Dropbox、Gemini、Google ChatのそれぞれとYoomを連携してください。

- トリガーは5分、10分、15分、30分、60分の間隔で起動間隔を選択できます。

- プランによって最短の起動間隔が異なりますので、ご注意ください。

- Google Chatとの連携はGoogle Workspaceの場合のみ可能です。詳細は下記を参照ください。

https://intercom.help/yoom/ja/articles/6647336 - ダウンロード可能なファイル容量は最大300MBまでです。アプリの仕様によっては300MB未満になる可能性があるので、ご注意ください。

- トリガー、各オペレーションでの取り扱い可能なファイル容量の詳細は下記をご参照ください。

https://intercom.help/yoom/ja/articles/9413924

■概要

Google Driveにアップロードされる画像を都度ダウンロードし、内容を確認して報告する作業は手間がかかるのではないでしょうか。

目視での確認は時間がかかる上に、重要な情報を見落とすリスクも伴います。

このワークフローを活用すれば、Google Driveに画像がアップロードされると、Geminiが自動で画像内容を解析し、その結果をLINE WORKSへ素早く通知できます。

一連の確認・報告業務を自動化し、作業負担の軽減にも役立つでしょう。

■このテンプレートをおすすめする方

- Google Driveで画像ファイルを管理しており、内容確認を手作業で行っている方

- Geminiの画像解析機能を活用して、日々の業務を効率化したいと考えている方

- LINE WORKSでの情報共有をより迅速かつ正確に行いたい方

■このテンプレートを使うメリット

- Google Driveへの画像アップロードから内容解析、LINE WORKSへの通知までを自動化し、これまで手作業で行っていた確認や報告の時間を短縮できます。

- 人の手を介さずに処理が完了するため、画像内容の見落としや関係者への報告漏れといったヒューマンエラーの発生を防ぎます。

■フローボットの流れ

- はじめに、Google Drive、Gemini、LINE WORKSをYoomと連携します。

- 次に、トリガーでGoogle Driveの「新しくファイル・フォルダが作成されたら」というアクションを設定します。

- 続けて、オペレーションでGoogle Driveの「ファイルをダウンロードする」アクションを設定し、トリガーで検知したファイルを指定します。

- 次に、Geminiの「ファイルをアップロード」アクションを設定し、ダウンロードしたファイルを指定します。

- さらに、オペレーションでGeminiの「コンテンツを生成(ファイルを利用)」アクションを設定し、アップロードしたファイルの内容を解析させます。

- 最後に、オペレーションでLINE WORKSの「トークルームにメッセージを送信」アクションを設定し、Geminiが生成した内容を指定のトークルームに通知します。

※「トリガー」:フロー起動のきっかけとなるアクション、「オペレーション」:トリガー起動後、フロー内で処理を行うアクション

■このワークフローのカスタムポイント

- 「コンテンツを生成(ファイルを利用)」する際のプロンプトは、「画像に写っているものを日本語でリストアップして」など、目的に応じて自由に設定が可能です。

- 「トークルームにメッセージを送信」で設定するメッセージの本文には、前段のGeminiで取得した解析結果などフロー内で取得した値を引用できます。

■注意事項

- Google Drive、Gemini、LINE WORKSをYoomと連携してください。

- トリガーは5分、10分、15分、30分、60分の間隔で起動間隔を選択できます。

- プランによって最短の起動間隔が異なりますので、ご注意ください。

- ダウンロード可能なファイル容量は最大300MBまでです。アプリの仕様によっては300MB未満になる可能性があるので、ご注意ください。

- トリガー、各オペレーションでの取り扱い可能なファイル容量の詳細はこちら

■概要

Dropboxにアップロードされる報告書や議事録などのファイルについて、その都度内容を確認しチームに共有する作業に時間を要していませんか。このワークフローは、Dropboxへのファイルアップロードをきっかけに、Geminiが自動でファイル内容を解析し、要約した結果をGoogle Chatへ通知するものです。GeminiとGoogle Chatを連携させることで、手動での確認や共有作業の手間を省き、スムーズな情報伝達を実現します。

■このテンプレートをおすすめする方

- Dropboxに保存したファイルの確認とGoogle Chatへの共有に手間を感じている方

- Geminiを活用した文書解析の自動化で、日々の定型業務を効率化したい方

- GeminiとGoogle Chatを連携させ、情報共有のスピードを向上させたいチームの方

■このテンプレートを使うメリット

- Dropboxへのファイルアップロードをトリガーに、Geminiによる解析からGoogle Chatへの通知までを自動化し、手作業の時間を削減します

- Geminiが設定したプロンプトに基づき内容を解析するため、人による要約のばらつきや共有漏れを防ぎ、情報共有の品質を均一化できます

■フローボットの流れ

- はじめに、Dropbox、Gemini、Google ChatをYoomと連携します

- 次に、トリガーでDropboxを選択し、「特定のフォルダ内でファイルが作成または更新されたら」アクションを設定します

- 続いて、オペレーションでDropboxの「ファイルをダウンロードする」アクションを設定し、トリガーで検知したファイルをダウンロードします

- 次に、Geminiの「ファイルをアップロードする」アクションで、先ほどダウンロードしたファイルをアップロードします

- 続けて、Geminiの「コンテンツを生成(ファイルを利用)」アクションで、アップロードしたファイルを基に指定したプロンプトで内容を生成します

- 最後に、オペレーションでGoogle Chatの「メッセージを送信する」アクションを設定し、Geminiが生成した内容を指定のスペースに通知します

※「トリガー」:フロー起動のきっかけとなるアクション、「オペレーション」:トリガー起動後、フロー内で処理を行うアクション

■このワークフローのカスタムポイント

- Dropboxのトリガー設定では、監視対象としたいフォルダのパスやファイル名を任意で設定できます

- Geminiでコンテンツを生成するアクションでは、解析対象のファイルを前段のDropboxで取得した情報から動的に設定することが可能です

- Geminiに与えるプロンプトは自由にカスタマイズでき、ファイル名などの情報を変数として組み込むことで、より文脈に沿った内容を生成させられます

- Google Chatへの通知先スペースは任意で選択でき、通知メッセージの本文にはGeminiの生成結果など、前段のアクションで取得した値を埋め込めます

■注意事項

- Dropbox、Gemini、Google ChatのそれぞれとYoomを連携してください。

- トリガーは5分、10分、15分、30分、60分の間隔で起動間隔を選択できます。

- プランによって最短の起動間隔が異なりますので、ご注意ください。

- Google Chatとの連携はGoogle Workspaceの場合のみ可能です。詳細は下記を参照ください。

https://intercom.help/yoom/ja/articles/6647336 - ダウンロード可能なファイル容量は最大300MBまでです。アプリの仕様によっては300MB未満になる可能性があるので、ご注意ください。

- トリガー、各オペレーションでの取り扱い可能なファイル容量の詳細は下記をご参照ください。

https://intercom.help/yoom/ja/articles/9413924

プログラミング知識なしで手軽に構築できます。